Am 16. März 2026 präsentierte NVIDIA mit DLSS 5 eine Technologie, die die Gaming-Welt in staunendes Entzücken und tiefste Skepsis zugleich versetzt hat. Hier geht es nicht mehr um simples Upscaling oder die bloße Zwischenbildberechnung zur Glättung der Performance. NVIDIA positioniert DLSS 5 als „Content-Control Generative AI“ – ein Paradigmenwechsel, der die Beziehung zwischen der Game-Engine und dem finalen Monitorbild grundlegend verändert.

Dies ist der bisher aggressivste Vorstoß von NVIDIA, die visuelle Qualität von der lokalen Hardware-Berechnung zu entkoppeln. Indem man sich von 3D-Daten abwendet und stattdessen auf 2D-Inferenz setzt, ersetzt NVIDIA die traditionelle Rendering-Pipeline faktisch durch ein generatives Modell, das „errät“, wie eine fotorealistische Welt aussehen sollte.

Eine massive Diskrepanz in der technischen Strategie

Der auffälligste Aspekt der DLSS-5-Ankündigung ist der Widerspruch zwischen der NVIDIA-Führungsebene und dem technischen Stab. Während der Präsentation behauptete CEO Jensen Huang, dass DLSS 5 auf der „Geometrie-Ebene“ operiere. Kurz darauf stellte NVIDIA-Sprecher Jacob Freeman jedoch klar, dass das System tatsächlich blind für 3D-Geometrie, Depth-Buffer und Material-Maps ist. Stattdessen nutzt es lediglich ein einzelnes gerendertes 2D-Bild und Bewegungsvektoren als Input.

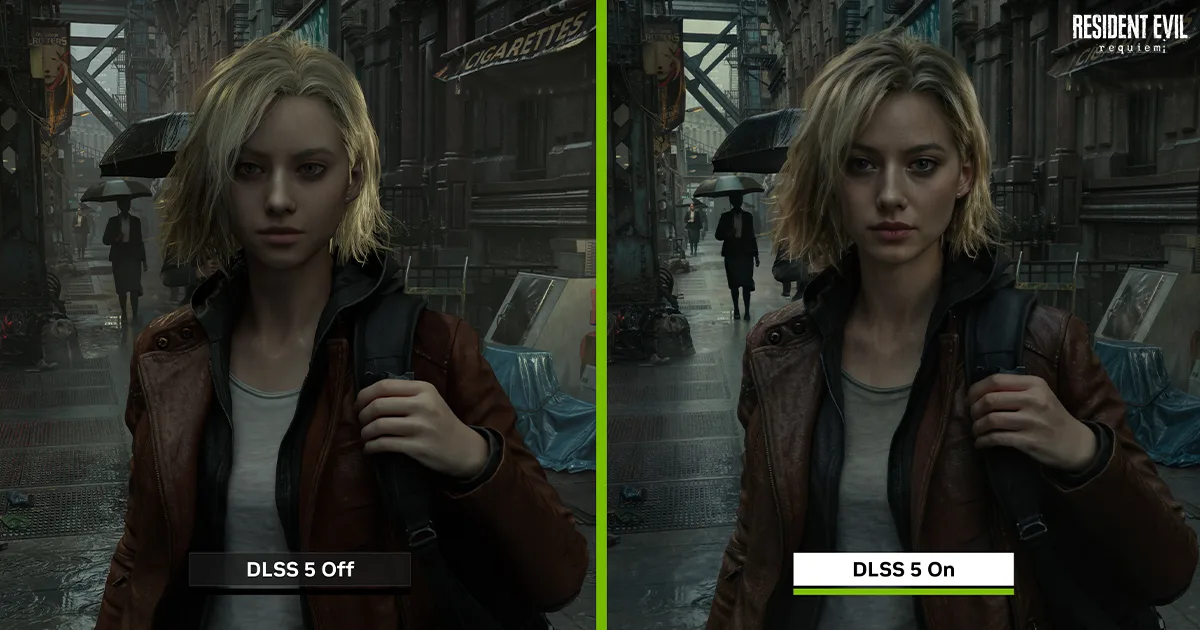

Diese Unterscheidung ist entscheidend. Wenn die KI die Geometrie nicht „sieht“, verbessert sie das Spiel nicht im herkömmlichen Sinne; sie interpretiert ein flaches Bild und zeichnet es neu. Dieser Wandel ist besorgniserregend, da sich die GPU nicht mehr für die Rohdaten des Entwicklers interessiert. Sie betrachtet ein Bild, erkennt ein Gesicht oder die Textur einer Jacke und nutzt ihre Trainingsdaten, um das Bild mit dem anzureichern, was sie für bessere Beleuchtung und Materialdetails hält.

DLSS 5 vs. vorherige Generationen

Um diesen Bruch mit der Tradition zu verstehen, muss man betrachten, was die KI im Vergleich zu den DLSS-Versionen der RTX 40er- oder 50er-Serien tatsächlich tut.

Da DLSS 5 vollständig im Screen-Space arbeitet, nimmt es nichts außerhalb des sichtbaren Rahmens wahr. Dies führt zu einem logischen Bruch: Die Game-Engine weiß, dass sich hinter einer Tür eine Lichtquelle befindet, aber DLSS 5 kennt nur das, was es sieht. Dies erklärt technische Artefakte in frühen Demos, wie Ghosting und flackernde Schatten, die Probleme mit der Konsistenz haben.

Das Problem der KI-Halluzinationen

KI-Halluzinationen plagen Sprachmodelle und Bildgeneratoren seit Jahren, doch sie nun in Echtzeit in Spielen zu erleben, ist Neuland. Da DLSS 5 darauf trainiert ist, „Semantiken“ wie Haare, Stoffe und lichtdurchlässige Haut zu erkennen, nimmt es sich oft künstlerische Freiheiten beim Quellmaterial.

In frühen Previews von Starfield bemerkten Kritiker, dass Charaktere plötzlich zusätzliche Details im Haar oder veränderte Gesichtszüge aufwiesen, die im ursprünglichen Modell nicht vorhanden waren. Noch alarmierender sind Berichte, wonach die KI Charakteren in düsteren, postapokalyptischen Szenarien Make-up hinzufügte – und damit die künstlerische Vision der Entwickler faktisch überschrieb.

Für Entwickler stellt dies einen Albtraum für die Qualitätskontrolle dar. Aktuell gibt es keine direkte Methode, um spezifische KI-generierte Artefakte zu korrigieren. Wenn die KI entscheidet, dass ein Charakter eine andere Nasenform oder einen glänzenderen Mantel haben sollte, bleibt dem Entwickler nur das Justieren globaler Schieberegler wie Intensität, Kontrast oder Gamma. Dieser Mangel an feingranularer Kontrolle wird ein massiver Streitpunkt für Studios sein, die auf eine spezifische ästhetische Identität Wert legen.

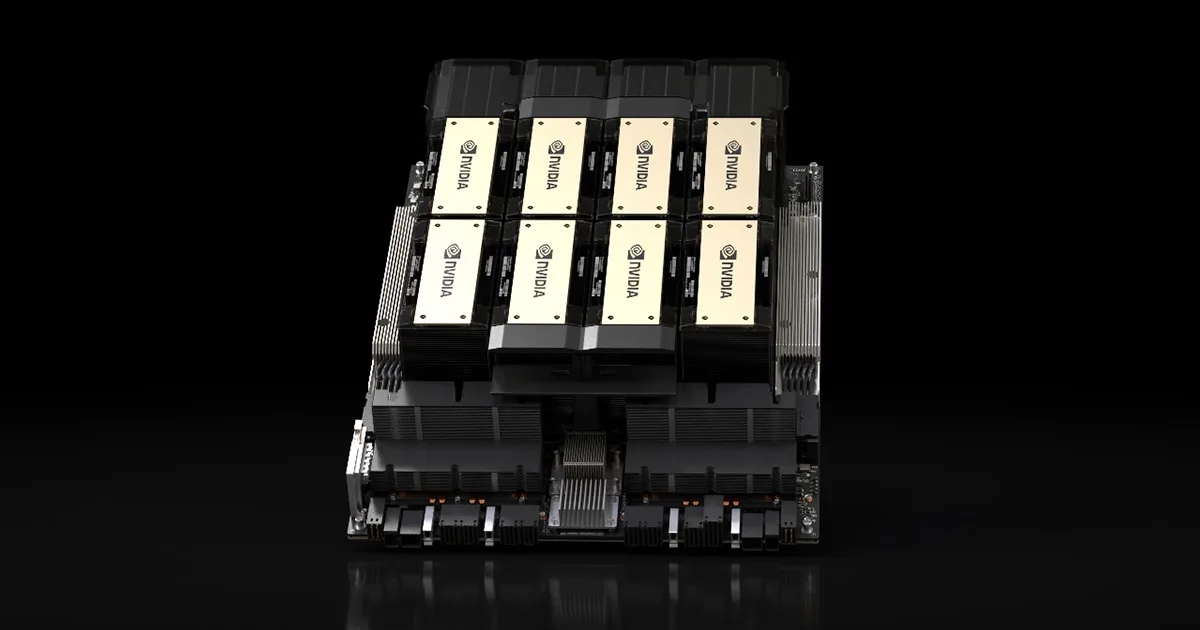

Anforderungen für neuronales Rendering in Echtzeit

Obwohl NVIDIA den Release für Endverbraucher für den Herbst 2026 forciert, sind die Hardware-Anforderungen derzeit astronomisch. Frühe Vorführungen benötigten Berichten zufolge zwei parallel laufende RTX 5090-Karten, um einen flüssigen Betrieb zu gewährleisten. Dies deutet darauf hin, dass „Echtzeit-Neural-Rendering“ noch weit davon entfernt ist, ein Mainstream-Feature zu werden.

Trotz der enormen Hardware-Last steht die Industrie bereits Schlange. Große Publisher wie Capcom, Ubisoft und Warner Bros. Games integrieren die Technologie in kommende Titel wie Resident Evil Requiem und Assassin’s Creed Shadows. Die Einbindung erfolgt über das NVIDIA Streamline-Framework, was die Implementierung in bestehende Titel theoretisch erleichtert. Es bleibt jedoch die Frage, ob diese visuellen Veränderungen den Verlust an künstlerischer Genauigkeit wert sind.

TTEK2 Urteil

DLSS 5 ist ein kühner, vielleicht sogar waghalsiger Versuch, die GPU in eine Echtzeit-Deepfake-Maschine zu verwandeln. Indem NVIDIA die 3D-Geometrie ignoriert und 2D-Frames „interpretiert“, priorisiert das Unternehmen wahrgenommenen Fotorealismus über technische Präzision und künstlerische Absicht.

Praktische Erkenntnisse:

- Für Enthusiasten: Erwarten Sie nicht, dass dies auf Mittelklasse-Hardware reibungslos läuft. Selbst die RTX 5090 scheint unter der Last von DLSS 5 ins Schwitzen zu kommen.

- Für Puristen: Diese Technologie ist ein Warnsignal. Wenn es Ihnen wichtig ist, exakt das zu sehen, was die Entwickler erschaffen haben, werden Sie die „Halluzinationen“ und die interpretierten Materialien von DLSS 5 vermutlich frustrieren.

- Für die Industrie: Dies markiert einen Wendepunkt. NVIDIA hilft Spielen nicht mehr nur dabei, schneller zu laufen; sie setzen sich selbst auf den Regiestuhl. Entwickler müssen nun entscheiden, ob sie die Kontrolle über ihre Charakterdesigns an einen Algorithmus abtreten wollen.

DLSS 5 wirkt wie eine Lösung, die nach einem Problem sucht. Wir möchten, dass unsere GPUs Spiele berechnen, nicht dass sie diese „neu interpretieren“. Bis NVIDIA den Entwicklern eine Möglichkeit bietet, die KI fest an die tatsächlichen 3D-Assets zu binden, riskiert diese Technologie, jedes Spiel in eine generische, KI-gefilterte Version seiner selbst zu verwandeln.

Kommentare