Die Phrase, die diese Woche die Runde macht – „Google TurboQuant RAM Preissturz“ – ist in zweierlei Hinsicht faktisch falsch.

Erstens: TurboQuant ist kein RAM-Produkt. Es handelt sich um einen Kompressionsalgorithmus von Google Research, der am 24. März 2026 in einem Blogpost und einem begleitenden Paper angekündigt wurde. Weitere Details folgten auf dem AI at Scale Summit am 30. März. Google beschreibt die Technologie als eine Methode zur Komprimierung des KV-Caches, der bei der Inferenz großer Sprachmodelle (LLMs) zum Einsatz kommt. Im weiteren Sinne ist es eine Vektorquantisierung für speicherintensive Workloads. Laut Google zielt die Entwicklung auf einen der größten Engpässe der KI-Inferenz ab: den Speicher-Overhead, der besonders bei wachsenden Kontextfenstern problematisch wird. Die Originalankündigung findet sich im Google Research Blog, während Analysen von Drittanbietern wie TechInformed das Thema ähnlich einordnen.

Zweitens: Die Preise für DDR5-Arbeitsspeicher im Endkundenmarkt sind nicht eingebrochen. Stand 1. April 2026 ähneln die US-Einzelhandelspreise für DDR5 eher einem Plateau als einem Absturz. Ein 2x16GB DDR5-6000 CL30 Kit kostete im Schnitt 529 $ und lag damit nur geringfügig unter der Spanne von 535–550 $ aus dem späten März. Dies deckt sich mit Preisindizes von Tom's Hardware und Marktanalysen von DropReference.

Was jedoch tatsächlich passiert ist, war eine heftige Marktreaktion in einem engeren Bereich: Aktien von Speicherchip-Herstellern erlebten nach der Google-Ankündigung massive Abverkäufe.

Was den Markt wirklich bewegte

Die Handelsdaten Ende März zeigen eine deutliche Reaktion der Investoren, auch wenn die Bezeichnung „RAM-Crash“ unpräzise ist.

Micron wurde beim Ausverkauf in den USA am härtesten getroffen. Innerhalb von zwei Tagen verlor die Aktie mehr als 14–15 %, was einen Marktwertverlust von über 25 Milliarden Dollar bedeutete. Der Abwärtstrend verschärfte sich am 30. und 31. März und führte zu mehreren Handelsunterbrechungen. Western Digital gab um 11–13 % nach, Seagate fiel um etwa 9 %. Der Schaden weitete sich auch auf den asiatischen Markt aus: SK Hynix verlor am 26. März 6,2–6,4 %, Samsung Electronics sank um ca. 4,7 % und Kioxia gab fast 6 % nach. CNBC fasste diese regionale Entwicklung zusammen und berichtete, dass südkoreanische Speicherwerte und Kioxia fielen, nachdem Googles Software-Ankündigung Investoren bezüglich der künftigen Speichernachfrage verunsichert hatte.

Dies beweist zwar nicht, dass TurboQuant den Speicherbedarf real schrumpfen lassen wird, zeigt aber, dass Händler die Technologie als glaubwürdige Bedrohung – oder zumindest als Grund für eine Neubewertung extrem hoher Erwartungen – ansehen.

Die Versprechen von TurboQuant und warum Investoren nervös wurden

Die Kernversprechen von Google sind der Grund für die schnelle Verbreitung der Nachricht.

TurboQuant soll den Speicherbedarf des KV-Caches um das Sechsfache reduzieren und in bestimmten Attention-Workloads eine bis zu 8-fache Beschleunigung liefern. Das Paper beschreibt ein System, das PolarQuant mit Quantized Johnson-Lindenstrauss (QJL)-Methoden kombiniert. Community-Analysen, wie eine Entwickler-Zusammenfassung auf Dev.to, erklären den Kernpunkt praxisnah: Die Komprimierung des KV-Caches auf etwa 3–4 Bits pro Element, ohne dass in den getesteten Setups ein erneutes Training oder Fine-Tuning nötig wäre.

Das ist deshalb von Bedeutung, weil der KV-Cache ein echter Kostentreiber bei der Inferenz ist. Wenn ein Modell mehr Kontext in weniger Speicher vorhalten kann, können Betreiber größere Workloads auf derselben Hardware ausführen, mehr Sitzungen pro GPU bewältigen oder den Kauf teurerer Speicherkonfigurationen hinauszögern. Theoretisch greift Software-Effizienz hier den Hardware-Bedarf von unten an.

Genau auf Basis dieser Theorie begannen die Abverkäufe.

Der Haken: Schlagzeilen entsprechen nicht der operativen Realität

An dieser Stelle muss die Analyse ins Detail gehen, da die Fakten ein differenzierteres Bild zeichnen.

Der vorliegende Forschungstext enthält mehrere Einschränkungen:

Diese Vorbehalte sind wichtiger, als es die Meme-Version der Geschichte vermuten lässt. Ein Laborergebnis zur KV-Cache-Kompression bedeutet nicht automatisch eine breite Reduzierung des gesamten Speicherbedarfs. Es könnte für bestimmte Inferenz-Workloads bedeutend sein, für andere jedoch kaum relevant und bis zur Verbesserung der Tools schwierig skalierbar sein.

Ein Medium verglich die Online-Reaktion scherzhaft mit der Serie Silicon Valley und der Firma Pied Piper, doch MakeMeTechie traf den entscheidenden Punkt: Es handelt sich vorerst noch um ein Ergebnis im Laborstadium.

Warum der Markt dennoch zuerst verkaufte

Trotz aller Unsicherheit war der Abverkauf nicht völlig irrational. Er war schnell, aber nicht grundlos.

Viele Speicherwerte wurden unter der Annahme gehandelt, dass KI-Inferenz und -Training den gesamten Sektor in einen lang anhaltenden Nachfragezyklus ziehen würden. TurboQuant traf einen schwachen Punkt in diesem Narrativ: Was passiert, wenn Software den Speicherbedarf pro Abfrage oder pro Modell massiv reduziert?

Genau so ordneten es mehrere Analysten ein.

Shawn Kim, Analyst bei Morgan Stanley, argumentierte, dass TurboQuant zwar den Speicherverbrauch pro Abfrage senken könnte, dies aber einen Jevons-Paradoxon-Effekt auslösen könnte: Günstigere Inferenz könnte die Gesamtnutzung von KI so stark steigern, dass die Gesamtnachfrage nach Speicher dennoch steigt. In dieser Lesart ist TurboQuant langfristig nicht zwangsläufig negativ für den Sektor; es verschiebt lediglich die Kostenkurve.

Andrew Rocha von Wells Fargo äußerte direktere Bedenken. Er sieht in TurboQuant einen Angriff auf die Kostenkurve der KI-Inferenz und wirft die Frage auf, wie viel Speicherkapazität langfristig wirklich benötigt wird, wenn die Systemanforderungen sinken.

Goldman-Sachs-Analyst Peter Callahan beschrieb die Kursbewegung eher als „Sanity Check“ (Plausibilitätsprüfung) denn als Panik. Investoren prüfen nun, ob der Superzyklus im Speichermarkt signifikante softwaregetriebene Effizienzgewinne überleben kann.

Mehrere Großbanken stuften den Sektor zudem von „Overweight“ auf „Neutral“ herunter und nannten als Grund eine mögliche strukturelle Verschiebung der KI-Investitionen von Hardware-Akkumulation hin zu Software-Optimierung.

Dies erklärt, warum ein Blogpost eines Forschungsteams Marktkapitalisierung in zweistelliger Milliardenhöhe vernichten konnte. Der Markt preiste keinen verifizierten Kollaps der DRAM-Nachfrage ein, sondern die Möglichkeit, dass die optimistischsten Prognosen zu simpel waren.

Warum es eigentlich nicht um Desktop-DDR5 geht

Ein Grund, warum die Schlagzeile vom „RAM-Crash“ in die Irre führt, ist die Vermischung völlig unterschiedlicher Märkte.

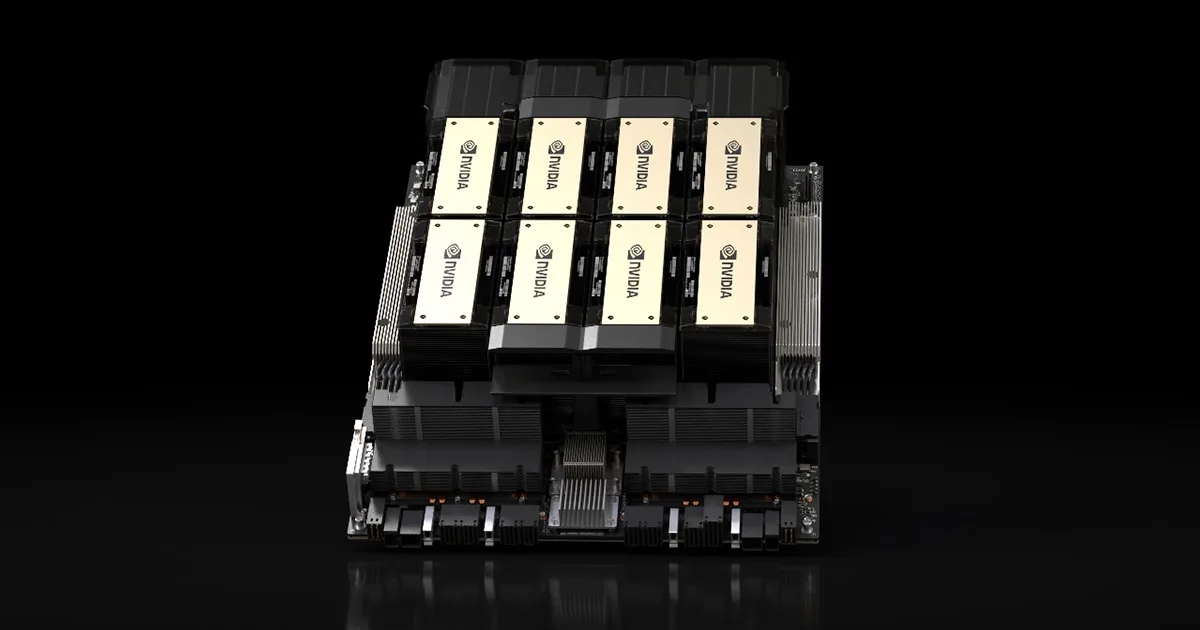

TurboQuant wird primär im Kontext der KI-Inferenz diskutiert, insbesondere mit Blick auf den Druck auf den GPU-Speicher. Die Leistungsreferenzen beziehen sich auf Beschleuniger der Klassen NVIDIA H100 und B200. Das ist nicht gleichzusetzen mit der Aussage, dass gewöhnliche DDR5-Module für Desktop-PCs plötzlich billiger werden müssen.

Selbst wenn sich TurboQuant als nützlich erweist, würden sich die Auswirkungen zuerst in der Wirtschaftlichkeit von Server-Inferenz, der Auslastung von Beschleunigern und der Planung von KI-Infrastrukturen zeigen. Die Preise für DDR5 im Einzelhandel hängen von einer Mischung aus PC-Nachfrage, Lagerbeständen, Vertragspreisen der Hersteller und Produktsegmentierung ab. Die aktuellen Fakten zeigen hier keinen Einbruch.

Das Gegenargument: Die Nachfrage ist bereits gebucht

Es gibt auch einen praktischen Grund, den Aktienrückgang nicht als endgültiges Urteil zu sehen.

Ein Sprecher von Micron erklärte, dass die HBM4-Kapazitäten des Unternehmens für das gesamte Jahr durch verbindliche Verträge ausverkauft sind, einschließlich der ersten fünfjährigen Kundenvereinbarung. Das widerlegt zwar nicht die These der Software-Effizienz, deutet aber darauf hin, dass die kurzfristige Nachfrage extrem robust bleibt, insbesondere in den hochwertigen KI-Speichersegmenten.

Das ist der Teil, den die Märkte oft vereinfachen: Ein Software-Durchbruch kann das langfristige Bedarfsmodell unter Druck setzen, während das aktuelle Angebot knapp, vertraglich gebunden und teuer bleibt. Beides kann gleichzeitig wahr sein.

Zeitliche Verwirrung und Datenrauschen

Ein kleinerer, aber relevanter Punkt: Selbst die Berichterstattung über den Zeitplan von TurboQuant war lückenhaft.

Einige Berichte nennen den 25. März als Veröffentlichungsdatum, während Googles offizielle Materialien auf den 24. März deuten. Zudem gibt es Unstimmigkeiten in den Aktientabellen verschiedener Aggregatoren. Dies ändert nichts am Gesamtbild, unterstreicht aber, wie schnell die Story sauber recherchierten Quellen entwachsen ist.

Auch dies mahnt zur Vorsicht bei pauschalen Behauptungen über einen „Crash“.

Worauf man als Nächstes achten sollte

Um zu beurteilen, ob sich hier eine echte Trendwende im Speichermarkt abzeichnet oder lediglich eine Überreaktion der Börse vorliegt, sind drei Punkte entscheidend:

- Offizielle Implementierung: Bisher hat Google keine offizielle Library oder Produktionsumgebung für TurboQuant veröffentlicht. Breit angelegte Auswirkungen hängen von der einfachen Bereitstellung und reproduzierbaren Benchmarks ab.

- Unabhängige Reproduktion: Die Zahlen „8x“ und „6x“ sind aufmerksamkeitsstark, entscheidend ist jedoch die Performance unter gängigen Inferenz-Bedingungen, in denen Betreiber oft schon jetzt Techniken mit geringerer Präzision nutzen.

- HBM- und Server-Kommentare: Falls TurboQuant das Kaufverhalten ändert, wird sich dies zuerst in der KI-Infrastrukturplanung zeigen und nicht im Preisregal für Endkunden-RAM.

Vorerst bleibt das Fazit nüchtern: TurboQuant scheint wichtig genug zu sein, um beobachtet zu werden, ist aber noch nicht weit genug gereift, um die Debatte um den Speichermarkt zu beenden. Sollten die Behauptungen in Produktionsumgebungen standhalten, könnten Speicherhersteller unter Druck geraten. Erweist sich die Implementierung als schwierig oder führt die günstigere Inferenz zu einem massiven Nutzungswachstum, könnte sich der aktuelle Ausverkauf als übertrieben herausstellen. Die Faktenlage stützt bisher Vorsicht in beide Richtungen – nur eben nicht den Begriff „RAM-Preis-Crash“.

Kommentare