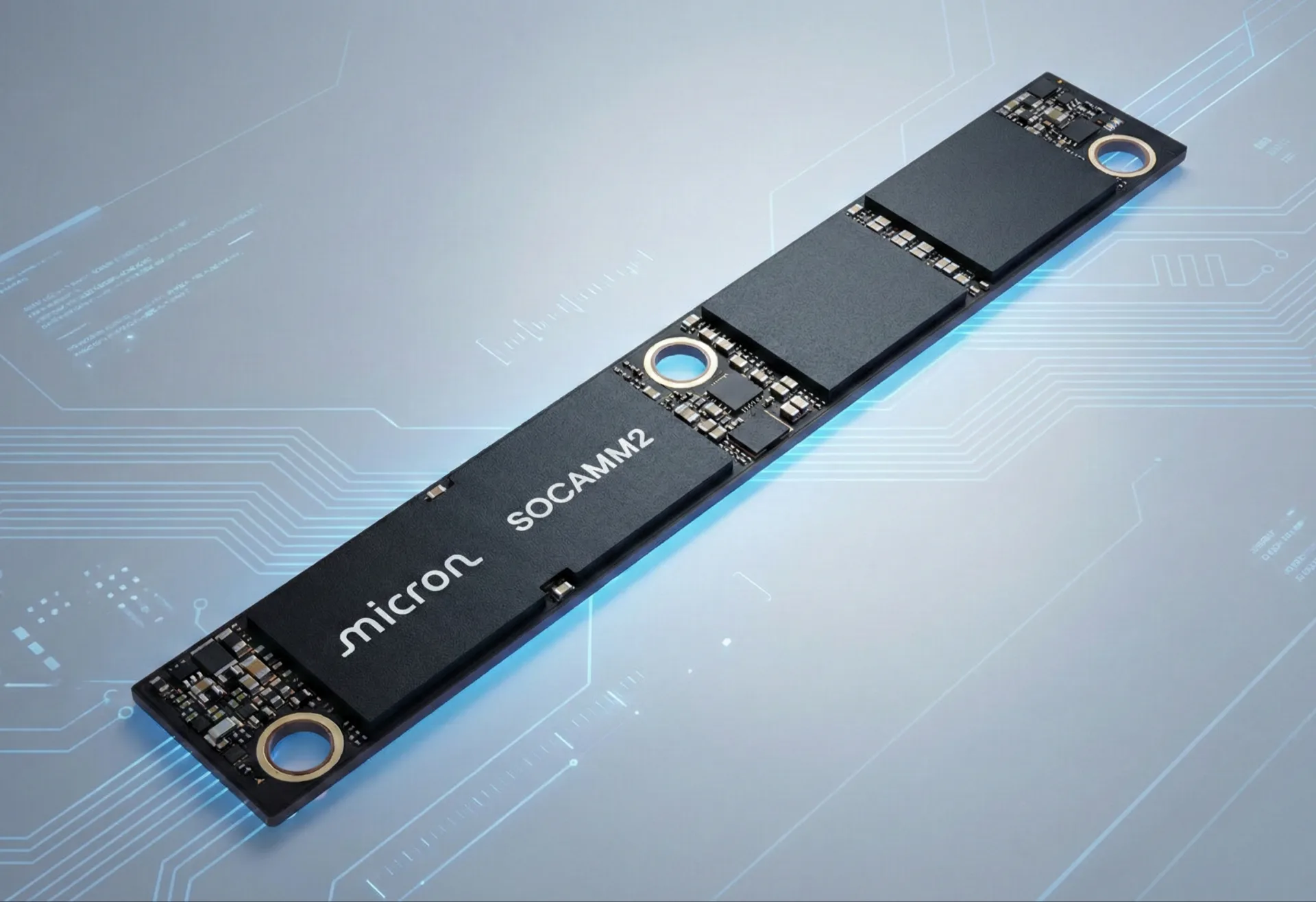

De felle strijd om de exploderende wereldwijde AI-infrastructuur van brandstof te voorzien, bereikt een kookpunt. Jarenlang was High Bandwidth Memory (HBM) de onbetwiste koning voor geavanceerde AI-accelerators. We zijn nu echter getuige van de opkomst van een nieuwe geheugenstandaard, SOCAMM2, die het speelveld fundamenteel kan veranderen. Terwijl we richting begin 2026 bewegen, wijzen signalen uit de industrie erop dat techreuzen AMD en Qualcomm klaarstaan om SOCAMM2 te integreren in hun aanstaande AI-productlijnen. Deze stap markeert een significante verschuiving, gericht op het herdefiniëren van geheugencapaciteit, energie-efficiëntie en de economische langetermijnwaarde binnen de uiterst competitieve markt voor AI-datacenters.

De AI-geheugenbottleneck: een persoonlijke uitdaging

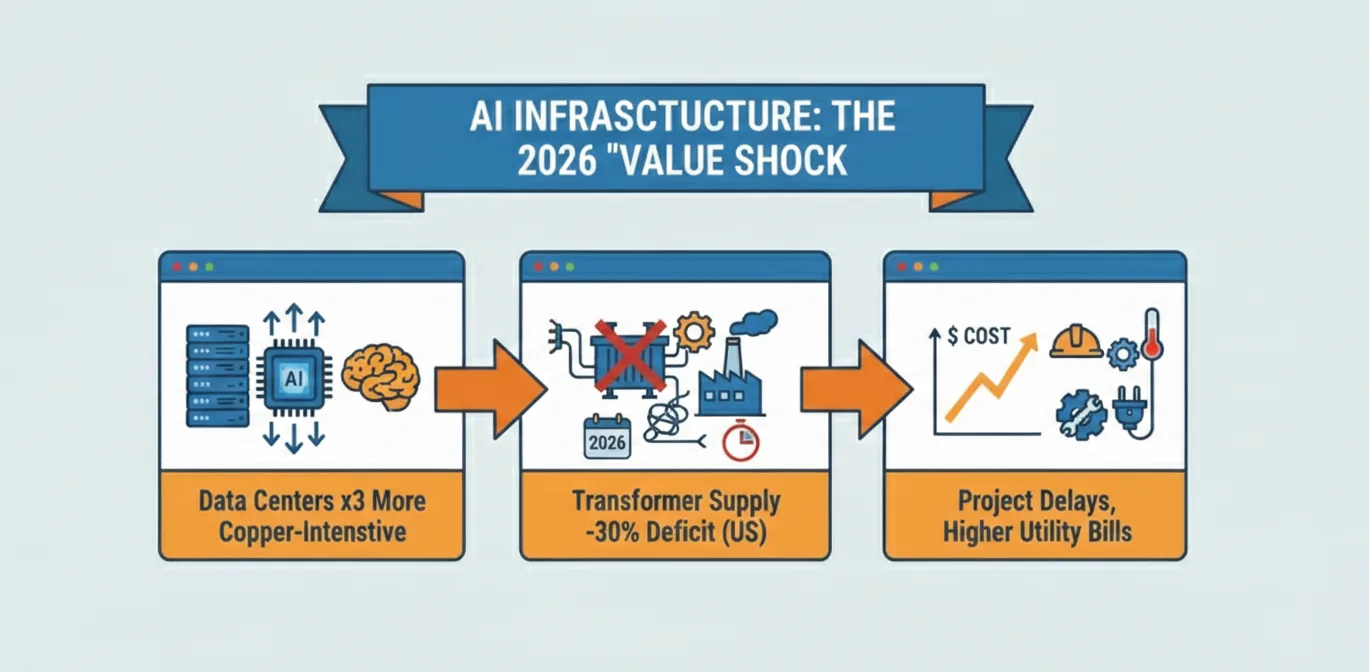

Veel te lang eiste de pure rekenkracht van AI-accelerators alle aandacht op. In onze optiek verschuift de werkelijke hardware-bottleneck voor AI echter razendsnel van pure FLOPs naar geheugen. De opmars van gigantische Large Language Models (LLM's) en complexe multimodale modellen (MMM's) heeft een onverzadigbare behoefte gecreëerd aan enorme geheugencapaciteit, uitzonderlijke energie-efficiëntie en schaalbare architecturen. Deze modellen vereisen dat ongekende hoeveelheden data "dichtbij" de verwerkingseenheden staan, niet alleen voor de initiële trainingsfasen, maar – wellicht nog belangrijker – voor inferentie: het dagelijks gebruik van AI-modellen in de praktijk.

NVIDIA, een bedrijf dat meer dan 90% van de AI-chipmarkt beheerst, is hier niet toevallig tegenaan gelopen. Zij waren de pioniers van het System-on-Chip Advanced Memory Module (SOCAMM) concept en steunden de SOCAMM2-standaard breed door deze te integreren in hun Vera Rubin-accelerators. Hoewel NVIDIA’s eerste poging met SOCAMM1 naar verluidt op technische hindernissen stuitte, wat leidde tot een herontwerp voor SOCAMM2, onderstreept hun voortdurende inzet het belang van deze standaard. Nu lijkt het erop dat AMD en Qualcomm dit voorbeeld volgen. Ze adopteren de standaard niet alleen, maar verkennen naar verluidt ook unieke implementaties om hun eigen concurrentiepositie te versterken.

SOCAMM2: Een nieuwe actieve werkruimte voor AI

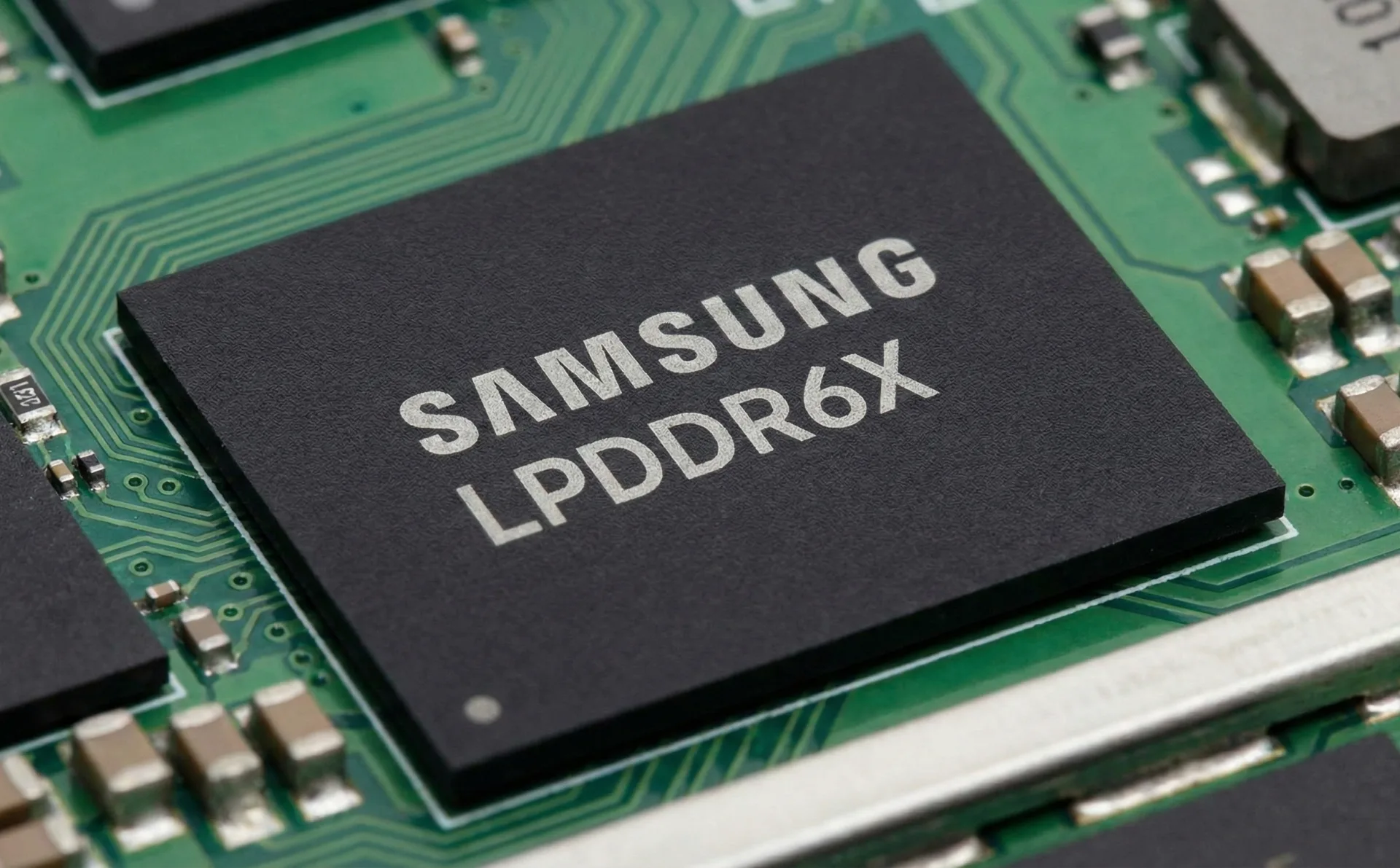

Wij beschouwen SOCAMM2 als een cruciale evolutionaire stap in de inzet van geheugen. Het overbrugt effectief de kloof tussen het traditionele gesoldeerde LPDDR-geheugen (Low Power Double Data Rate), bekend van mobiele apparaten, en de minder energiezuinige DIMM-modules voor servers. SOCAMM2 bevindt zich strategisch tussen het ultrasnelle maar capaciteitsbeperkte HBM en het conventionele systeem-DRAM, waardoor een nieuwe "Active Workspace" of "near-end memory pool" ontstaat, specifiek voor AI-toepassingen.

Waarom SOCAMM2 het verschil maakt:

- Modulair en vervangbaar: In tegenstelling tot permanent gesoldeerd LPDDR, zijn SOCAMM2-modules afneembaar. Dit is geen kleine luxe; voor datacenters is dit een kritieke factor voor de levensduur van platforms, omdat het upgrades, vervangingen en onderhoud vereenvoudigt. Wij geloven dat dit de Total Cost of Ownership (TCO) op de lange termijn aanzienlijk verlaagt.

- Gebaseerd op LPDDR: Door gebruik te maken van LPDDR5X (en in de toekomst LPDDR6), profiteert SOCAMM2 van inherent energiezuinige technologie. Vooral LPDDR6 belooft niet alleen meer bandbreedte (naar verwachting 38,4 GB/s per kanaal), maar ook een ongeveer 20% lager stroomverbruik dan LPDDR5X – essentieel voor hyperscale AI-operaties.

- Hoge capaciteit en bandbreedte: Deze modules zijn krachtig; Micron test momenteel al eenheden tot 192 GB. In systemen zoals NVIDIA's GB300 NVL72 kan SOCAMM2 op basis van LPDDR5X maar liefst 18 TB aan geheugen leveren met een systeembandbreedte van ongeveer 16 TB/s. Zelfs individuele modules bieden snelheden van 9.600 MT/s, wat twee keer de bandbreedte is van traditionele DDR5 RDIMM's.

- Energiezuinigheid: Dankzij de LPDDR-technologie verbruikt SOCAMM2 minder stroom dan standaard RDIMM's op basis van DRAM. Dit is cruciaal voor massale AI-implementaties waarbij elke watt bijdraagt aan de stijgende energiekosten.

- Compacte voetafdruk: Het ontwerp vereenvoudigt de lay-out van printplaten en de koeling in dichte systemen – een noodzaak voor de rack-scale AI-systemen die momenteel de markt domineren.

- JEDEC-standaard: De verwachting dat SOCAMM2 zal voldoen aan de JEDEC JESD328-norm is van vitaal belang. Dit garandeert uitwisselbaarheid en onafhankelijkheid van leveranciers, wat naar onze verwachting zal leiden tot een gezondere en concurrerende toeleveringsketen.

In essentie stelt SOCAMM2 AI-modellen in staat om miljoenen tokens en langdurige staten direct in de "near-end memory pool" van de accelerator te bewaren. Dit vermindert het dataverkeer tussen nodes drastisch en verhoogt de algehele systeemefficiëntie. Hoewel de doorvoer lager is dan bij HBM en de latentie hoger kan zijn dan bij standaard DDR5, geloven wij dat deze beperkingen vaak worden overschat. Voor de continue doorvoereisen van veel AI-workloads, vooral bij inferentie, wegen de voordelen in capaciteit en energieverbruik zwaarder.

Qualcomms gedurfde gooi naar dominantie in inferentie

Qualcomm, een veteraan in mobiele processoren, betrad op 27 oktober 2025 officieel de markt voor AI-datacenters met de onthulling van de AI200- en AI250-inferentie-accelerators. Deze chips, gepland voor 2026 (AI200) and 2027 (AI250), vormen een directe uitdaging voor NVIDIA en AMD, met een focus op AI-inferentie voor LLM's en MMM's.

De strategie van Qualcomm rust volgens onze analyse op een paar kernpunten:

- Energie-efficiëntie en TCO: Met een opgegeven stroomverbruik van 160 kW per rack voor hun vloeistofgekoelde oplossingen, geeft Qualcomm prioriteit aan een lage TCO. Dit sluit perfect aan bij de energievoordelen van SOCAMM2. Wij zien dit als een slimme zet, aangezien energiekosten een hoofdpijndossier zijn voor datacenterbeheerders.

- Enorme LPDDR-capaciteit: De AI200- en AI250-kaarten zijn ontworpen om elk tot 768 GB aan LPDDR-geheugen te bevatten. Deze enorme capaciteit is ideaal voor het verwerken van de gigantische contextvensters van moderne AI-modellen. Qualcomm claimt hiermee "meer geheugencapaciteit voor minder geld" te bieden dan de concurrentie.

- Innovatieve geheugenarchitectuur: Vooral de AI250 beschikt over een "near-memory computing" ontwerp. Qualcomm beweert dat dit een "generationele sprong in efficiëntie en prestaties" oplevert, met een effectieve geheugenbandbreedte die tot 10 keer hoger ligt dan bij huidige NVIDIA-GPU's. Hoewel we dergelijke "10x"-claims altijd met een korreltje zout nemen tot er onafhankelijke benchmarks zijn, is de richting duidelijk.

- Systemen op rack-schaal: Qualcomm verkoopt niet alleen chips; ze bieden volledige vloeistofgekoelde serverracks aan die tot 72 chips als één enkele computer kunnen aansturen. Dit komt overeen met de ambities van de rack-scale oplossingen van NVIDIA en AMD.

- Unieke PMIC-integratie: Berichten suggereren dat Qualcomm, samen met AMD, een SOCAMM-ontwerp onderzoekt waarbij het energiebeheer (PMIC) direct op de module is geïntegreerd. Dit ontwerp, met vierkante modules en vier DRAM-chips, vereenvoudigt de productie van moederborden en maakt een strakkere spanningscontrole mogelijk, wat essentieel is voor de hoge datasnelheden van LPDDR5X/LPDDR6.

De vroege samenwerking van Qualcomm met het Saoedische Humain, die vanaf 2026 systemen wil inzetten met een totaal vermogen van 200 megawatt, toont aan dat er concrete marktinteresse is voor hun op inferentie gerichte, LPDDR-zware aanpak.

De strategische positie van AMD en de schaduw van OpenAI

Hoewel de specifieke SOCAMM2-plannen van AMD in dit stadium minder gedetailleerd zijn dan die van Qualcomm, wijzen rapporten erop dat zij de technologie ook integreren in hun toekomstige AI-producten. Dit is strategisch zeer logisch, gezien hun directe concurrentiestrijd met NVIDIA. AMD heeft al een sterk portfolio van server-CPU's en GPU's; het toevoegen van SOCAMM2 zou hun geheugencapaciteit en snelheid aanzienlijk verbeteren.

Wij verwachten dat de motivatie van AMD vergelijkbaar is met die van Qualcomm: het benutten van LPDDR voor superieure energie-efficiëntie. Ook de bredere marktcontext is van belang. OpenAI zou plannen hebben om niet alleen chips bij AMD te kopen, maar mogelijk ook een belang in het bedrijf te nemen. Dit zou AMD een enorm momentum kunnen geven in de AI-chipmarkt en de druk op de dominantie van NVIDIA verder opvoeren.

De bredere implicaties: een krachtmeting in het datacenter

De verwachte omarming van SOCAMM2 door AMD en Qualcomm signaleert een brede beweging in de industrie naar geoptimaliseerde geheugenoplossingen. Met een verwachte marktwaarde voor AI-servers van 298 miljard dollar tegen 2025, is de inzet torenhoog.

Deze verschuiving kent echter ook uitdagingen:

- Thermisch beheer: Het samenbrengen van talloze LPDDR-chips in een compacte module creëert een enorme hitteconcentratie. Vloeistofkoeling, zoals te zien bij Qualcomm, verschuift van een niche-oplossing naar een absolute noodzaak.

- Ontwikkeling van LPDDR6: Hoewel veelbelovend, bevindt LPDDR6 zich nog in de testfase. Onzekerheden over massaproductie en stabiliteit op lange termijn blijven bestaan.

- Commerciële drempels: De hoge snelheden van SOCAMM2 vereisen mogelijk aanpassingen aan oudere geheugencontrollers, wat de adoptie bij sommige partijen kan vertragen. De werkelijke waarde moet komen van de totale systeemefficiëntie, niet alleen de prijs van de module.

- NVIDIA's ecosysteem: De grootste uitdaging voor nieuwkomers blijft het CUDA-softwareplatform van NVIDIA. Dit ecosysteem zorgt voor een sterke "lock-in" bij ontwikkelaars. AMD en Qualcomm zullen niet alleen hardware, maar ook naadloze software-integratie moeten bieden om klanten weg te lokken.

Ondanks deze hindernissen wijst het brede front achter SOCAMM2 – inclusief NVIDIA, Samsung, SK Hynix en Micron – op een rotsvast geloof in het potentieel van de standaard. Hoewel grote volumes pas begin 2027 worden verwacht, legt het werk van Qualcomm en AMD in 2026 de basis voor een dramatische herschikking van de AI-geheugenhiërarchie. SOCAMM2 vormt de fundering voor een duurzamere en schaalbare toekomst van kunstmatige intelligentie.

Reacties