Dans l'univers en constante ébullition de l'intelligence artificielle, GitHub Copilot est souvent présenté comme le fer de lance de la révolution du développement. Microsoft, sa maison mère, ne tarit pas d'éloges sur cet assistant de codage, affirmant qu'il a permis de réduire le temps de révision du code, d'accélérer la vélocité des développeurs et de générer une croissance de revenus de plus de 40 % au dernier trimestre 2024. Pour beaucoup d'entre nous, l'outil est devenu indispensable pour générer rapidement du code répétitif (boilerplate), des données de test ou des maquettes, allégeant ainsi la charge mentale quotidienne.

Pourtant, derrière cette vitrine de productivité accrue, une inquiétude grandissante se fait sentir. Que ce soit sur Reddit, Hacker News ou même dans les couloirs de Microsoft, les témoignages convergent vers une réalité plus nuancée : si Copilot est un accélérateur indéniable, il comporte aussi des failles majeures. Le signe le plus révélateur de ce malaise est sans doute l'approche prudente de Microsoft, qui semble désormais chercher des alternatives pour ne pas dépendre uniquement de sa propre solution.

La face cachée de Copilot : quand la vitesse nuit à la stabilité

Au premier abord, les chiffres de Copilot impressionnent. Conçu comme une surcouche aux modèles de langage comme ChatGPT, l'outil vise l'efficacité pure. L'omniprésence du code généré par IA est une réalité : en avril 2025, près de 30 % de la base de code de Microsoft était issue de l'IA, une tendance que l'on retrouve également chez Google. Mais chez TTEK2, nous nous interrogeons sur la qualité réelle de cette expansion galopante.

Le retour d'expérience des développeurs est loin d'être unanime :

- Hallucinations et perte de temps : De nombreux utilisateurs signalent que Copilot "invente" parfois des API entières. Un commentaire sur Hacker News résume bien la situation : « Copilot me fait gagner 30 minutes d'écriture, mais me coûte 2 heures de débogage. » Pour un développement professionnel rigoureux, ce compromis est difficilement acceptable.

- Un faux sentiment de sécurité : Une étude publiée par Microsoft, intitulée "The False Sense of Security in AI Pair Programming", révèle un point alarmant : les développeurs relisant du code généré par IA laissent passer 40 % de bugs en plus par rapport au code écrit par des humains. L'apparence "propre" du code généré masque souvent des erreurs subtiles et pernicieuses.

- Dépendance et stagnation technique : L'outil encourage parfois une trop grande passivité, transformant l'autocomplétion en véritable pilotage automatique. Sur Reddit, des fils de discussion s'inquiètent de voir les développeurs juniors apprendre moins en se contentant de suivre les schémas de l'IA sans comprendre les concepts fondamentaux.

- Fatigue de la révision de code : Paradoxalement, Copilot peut alourdir le processus. Des équipes internes chez Microsoft ont vu la taille des Pull Requests (PR) exploser, passant de 200 à 700 lignes, avec une proportion de code IA atteignant 70 %. Cela ne s'appelle plus de l'efficacité, mais de la saturation.

- Risques de propriété intellectuelle et confidentialité : Microsoft décline toute responsabilité quant à l'exactitude du code produit ou au respect des licences logicielles. Pour certains experts juridiques, Copilot agit comme un "trou noir" des droits de propriété intellectuelle, brisant le lien entre le code source ouvert utilisé pour l'entraînement et le résultat produit. De plus, le fait que l'outil puisse transmettre tout ce qui est tapé au clavier pose de graves questions de secret industriel pour les entreprises.

Certains développeurs internes vont même jusqu'à qualifier les PR générées par IA de « syndrome de Stockholm en tant que service », tandis que d'autres jugent l'outil médiocre pour les tâches de codage les plus basiques.

En coulisses : pourquoi Microsoft explore la concurrence

Face à ces défis, Microsoft fait preuve d'un pragmatisme surprenant. Plutôt que de s'enfermer dans une promotion exclusive de Copilot, le géant technologique teste activement des solutions concurrentes en interne.

L'année dernière, la division développement de Microsoft a mené une expérience comparative entre GitHub Copilot, GPT-5 d'OpenAI et Claude 4 d'Anthropic. Ce processus d'évaluation rigoureux est crucial pour définir la stratégie future des modèles qui alimenteront ses outils.

Plus significatif encore, Microsoft teste actuellement l'outil "Claude Code" d'Anthropic. Ce dernier reçoit des critiques élogieuses pour sa capacité à résoudre des problèmes complexes avec un style de codage plus "propre" et une fenêtre de contexte plus large. Même Jensen Huang, PDG de Nvidia, a qualifié Claude d'« incroyable », encourageant les entreprises de logiciel à l'adopter. Microsoft a même incité ses employés de la division 'Experiences + Devices' à expérimenter Claude, y compris ceux n'ayant aucune expérience préalable en programmation.

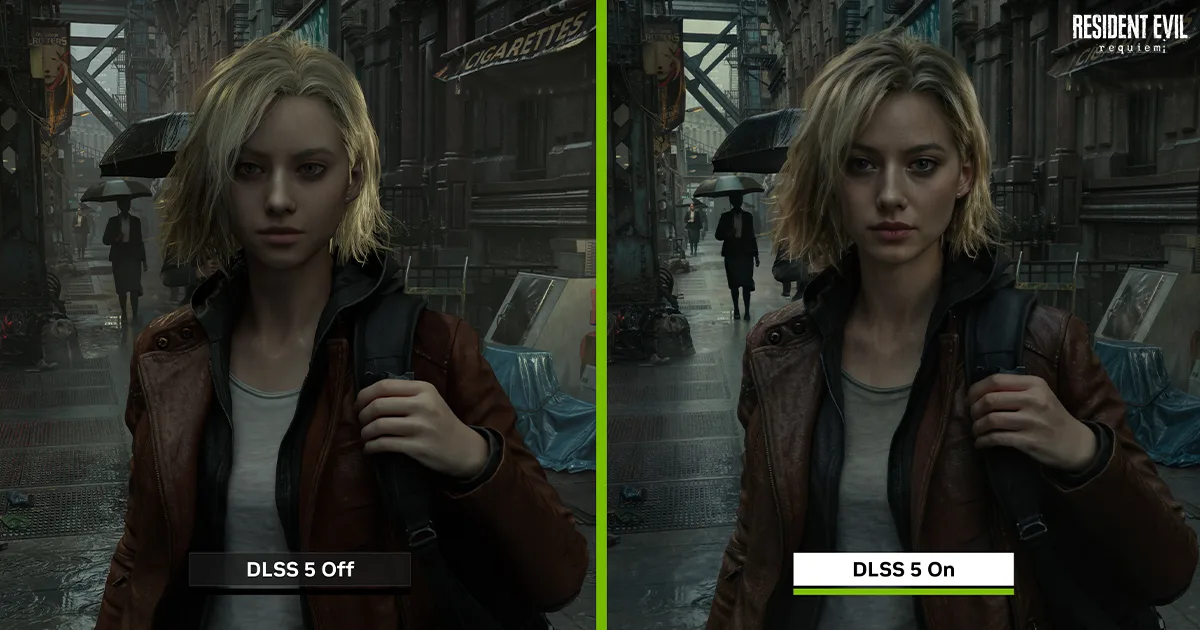

Voici une synthèse des différences perçues et du sentiment des développeurs :

Bien que la version entreprise de Claude Code soit nettement plus onéreuse, ses capacités de résolution de problèmes justifient l'intérêt de Microsoft, surtout pour les tâches critiques où la fiabilité prime sur le coût.

La stratégie Azure : héberger tout l'écosystème

L'intérêt de Microsoft pour les modèles concurrents ne signifie pas un aveu d'échec. C'est une manœuvre calculée pour faire d'Azure la plateforme incontournable de tous les modèles d'IA.

En novembre 2025, un partenariat stratégique entre Microsoft, Anthropic et Nvidia a renforcé cette vision. Avec un investissement de 5 milliards de dollars dans Anthropic, Microsoft s'assure que cette dernière achètera pour 30 milliards de dollars de services Azure. Bien que le partenariat avec OpenAI reste prioritaire, Microsoft maintient une relation solide avec Anthropic, allant jusqu'à récompenser ses équipes commerciales pour la vente de modèles concurrents sur Azure.

Cette stratégie multi-partenaires s'incarne dans "Microsoft Foundry pour Visual Studio Code", une plateforme offrant un catalogue de modèles variés (OpenAI, Meta, DeepSeek, Anthropic). En diversifiant l'offre, Microsoft se protège : quel que soit l'outil qui gagnera la guerre du codage, il tournera probablement sur l'infrastructure Azure.

Un futur sous surveillance : naviguer entre les mines

L'adoption de l'IA dans le développement logiciel est irréversible. Toutefois, les défis soulevés par Microsoft elle-même imposent une grande vigilance :

- Qualité et Confiance : Le caractère non déterministe de l'IA signifie que l'on ne peut pas lui faire une confiance aveugle. Déboguer les hypothèses erronées d'un modèle est souvent plus ardu que de corriger du code humain.

- Auditabilité et Droit : Le flou juridique entourant la provenance du code généré reste un obstacle majeur pour les entreprises traitant des données sensibles ou des algorithmes propriétaires.

- L'impact humain : On craint une dévaluation du savoir-faire. Si les développeurs se contentent de valider des suggestions sans les comprendre, c'est toute la profession qui risque de stagner.

Conclusion : un pivot vers le pragmatisme

Les tests internes de Microsoft prouvent une chose : l'entreprise a conscience des limites actuelles de l'IA. Si GitHub Copilot a tenu ses promesses en termes de vitesse, ses lacunes en précision et en sécurité obligent à une diversification.

Il ne s'agit pas d'abandonner Copilot, mais d'utiliser le bon outil pour la bonne tâche. L'exploration de solutions comme Claude Code et l'ouverture d'Azure à tous les modèles montrent que Microsoft privilégie désormais une approche pragmatique. La course à la vitesse doit être équilibrée par des impératifs de qualité et de sécurité. L'industrie observera de près comment Microsoft navigue dans ces eaux troubles pour proposer des solutions qui ne soient pas seulement rapides, mais fondamentalement fiables.

Commentaires