L’expression qui circule cette semaine — « le crash des prix de la RAM dû à Google TurboQuant » — repose sur deux erreurs majeures d'interprétation.

Premièrement, TurboQuant n'est pas un produit de mémoire vive (RAM). Il s'agit d'un algorithme de compression issu de Google Research, annoncé le 24 mars 2026 via un billet de blog et un document de recherche, avec des détails supplémentaires présentés lors du sommet AI at Scale le 30 mars. Google le décrit comme une méthode de compression du cache KV utilisé lors de l'inférence des grands modèles de langage (LLM), et plus largement comme une technique de quantification vectorielle pour les charges de travail gourmandes en mémoire. Selon les propres termes de Google, cette technologie cible l'un des principaux goulots d'étranglement de l'IA : la surcharge de mémoire, en particulier lorsque les fenêtres de contexte s'élargissent. L'annonce originale est disponible sur le blog Google Research, et des analyses externes, comme celle de TechInformed, ont relayé cette information sous un angle similaire.

Deuxièmement, les prix de la RAM DDR5 grand public n'ont pas subi de crash. Au 1er avril, les tarifs de vente au détail aux États-Unis ressemblent davantage à un plateau qu'à un effondrement. Un kit de 2x16 Go DDR5-6000 CL30 s'échangeait en moyenne à 529 $, soit une baisse très modeste par rapport à la fourchette de 535 $ à 550 $ observée fin mars. Cela concorde avec le suivi des prix de Tom's Hardware et l'analyse de marché de DropReference.

L'événement réel est plus ciblé, mais tout aussi significatif : les actions des entreprises de semi-conducteurs liées à la mémoire ont lourdement chuté suite à l'annonce de Google et aux débats qui ont suivi.

Les mouvements réels du marché

Les échanges de la fin mars montrent une réaction claire du marché, même si l'étiquette de « crash de la RAM » est abusive.

Micron a été la plus durement touchée lors de la vente massive aux États-Unis. En deux jours, l'entreprise a perdu plus de 14 à 15 % de sa valeur, effaçant plus de 25 milliards de dollars de capitalisation boursière. Le déclin s'est intensifié les 30 et 31 mars, entraînant plusieurs suspensions de séance. Western Digital a chuté de 11 à 13 %, Seagate d'environ 9 %, et les dégâts se sont propagés en Asie : SK Hynix a perdu 6,2 à 6,4 % le 26 mars, Samsung Electronics environ 4,7 %, et Kioxia a reculé de près de 6 %. CNBC a résumé la situation en expliquant que les géants sud-coréens et Kioxia ont plongé après que l'annonce logicielle de Google a effrayé les investisseurs quant à la future demande en matériel.

Cela ne prouve pas que TurboQuant réduira matériellement la demande globale de mémoire, mais cela démontre que les traders y ont vu une menace crédible — ou du moins un prétexte suffisant pour réévaluer des attentes boursières très élevées.

Les promesses de TurboQuant et l'inquiétude des investisseurs

Si l'information s'est propagée si vite, c'est en raison des chiffres avancés par Google.

TurboQuant est présenté comme capable de réduire l'usage de la mémoire du cache KV par au moins 6 et d'offrir des gains de vitesse allant jusqu'à 8x pour certaines tâches d'attention. Le document de recherche explique que le système combine les méthodes PolarQuant et Quantized Johnson-Lindenstrauss (QJL). Des analyses communautaires ont traduit cela en termes pratiques : compresser le cache KV à environ 3 ou 4 bits par élément sans nécessiter de réentraînement ou d'ajustement fin du modèle, comme le souligne un résumé pour développeurs sur Dev.to.

C'est crucial car le cache KV représente un centre de coût majeur pour l'inférence. Si un modèle peut conserver plus de contexte avec moins de mémoire, les opérateurs pourraient traiter des charges de travail plus importantes sur une infrastructure identique, héberger plus de sessions par GPU ou retarder l'achat de configurations mémoire plus coûteuses. En théorie, l'efficacité logicielle attaque la demande matérielle par la base.

C'est cette théorie qui a poussé les investisseurs à vendre.

Le bémol : les chiffres de l'annonce ne sont pas encore une réalité de terrain

C'est ici que l'analyse doit se faire plus prudente, car les détails techniques comptent.

Les documents de recherche disponibles comportent plusieurs nuances importantes :

Ces nuances sont plus importantes que ne le laisse suggérer la version « virale » de l'histoire. Un résultat de laboratoire sur la compression du cache KV ne signifie pas automatiquement une baisse généralisée de la demande de mémoire. Cela pourrait être crucial pour certaines tâches d'inférence, mais peu pertinent pour d'autres, et difficile à déployer à grande échelle avant que les outils ne s'améliorent.

Un média a comparé la réaction en ligne à une scène de la série Silicon Valley d'HBO avec l'algorithme Pied Piper, mais MakeMeTechie apporte une précision plus utile : pour l'instant, cela reste un résultat au stade de la recherche.

Pourquoi le marché a tout de même réagi si vite

Malgré ces incertitudes, la vente massive n'était pas irrationnelle. Elle a été rapide, mais pas sans fondement.

De nombreux titres du secteur de la mémoire étaient valorisés sur l'idée que l'inférence et l'entraînement de l'IA maintiendraient le secteur dans un cycle de demande ascendante prolongé. TurboQuant a touché un point sensible de ce narratif : et si le logiciel commençait à réduire la quantité de mémoire nécessaire pour chaque requête ou chaque modèle déployé ?

C'est ainsi que plusieurs analystes ont interprété la situation.

Shawn Kim, analyste chez Morgan Stanley, soutient que si TurboQuant pourrait réduire l'usage de mémoire par requête, cela pourrait aussi déclencher un effet de paradoxe de Jevons : en rendant l'inférence moins chère, l'usage total de l'IA pourrait augmenter au point que la demande globale de mémoire continue de croître. Dans cette optique, TurboQuant n'est pas forcément négatif pour le secteur à long terme ; il pourrait simplement déplacer la courbe des coûts.

Andrew Rocha, analyste chez Wells Fargo, a pris la menace plus au sérieux, affirmant que TurboQuant s'attaque directement à la courbe des coûts de l'inférence IA et soulève la question de la capacité mémoire réellement nécessaire à long terme si les spécifications matérielles diminuent.

Peter Callahan, chez Goldman Sachs, a décrit ce mouvement comme un « test de réalité » (sanity check) plutôt qu'une panique, les investisseurs se demandant si le super-cycle de la mémoire peut survivre à des gains d'efficacité logicielle majeurs.

Plusieurs grandes banques ont également abaissé leur recommandation sur le secteur de la mémoire de « Surpondérer » à « Neutre », citant un possible basculement structurel des investissements IA vers l'optimisation logicielle plutôt que l'accumulation matérielle.

Ce faisceau d'opinions explique pourquoi un simple billet de blog de recherche a pu effacer des dizaines de milliards de dollars de valeur boursière. Le marché n'anticipait pas un effondrement vérifié de la demande de DRAM, mais la possibilité que les prévisions les plus optimistes aient été trop simplistes.

Pourquoi cela ne concerne pas vraiment la DDR5 de bureau

L'une des raisons pour lesquelles le titre « crash de la RAM » est trompeur est qu'il mélange des marchés très différents.

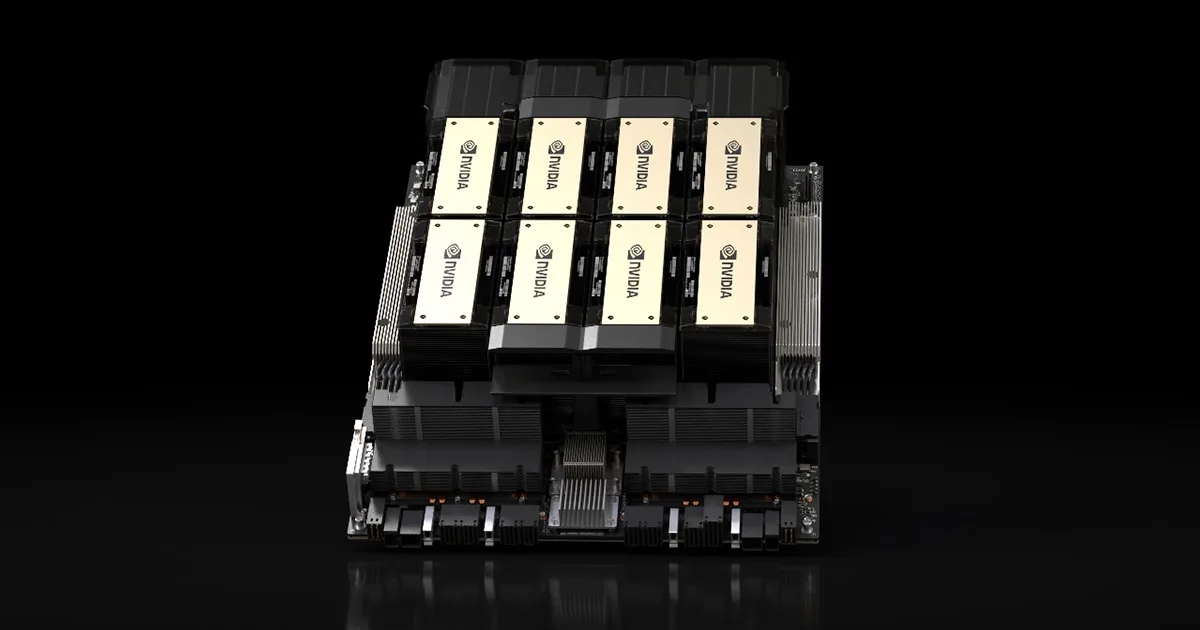

TurboQuant est discuté principalement dans le contexte de l'inférence IA, notamment autour de la pression sur la mémoire GPU et du cache KV. Les références de performance mentionnent des accélérateurs de classe NVIDIA H100 et B200. Cela n'a rien à voir avec le prix des barrettes DDR5 classiques pour PC de bureau.

Même si TurboQuant s'avère utile, le premier effet visible se situerait sur l'économie de l'inférence serveur, l'utilisation des accélérateurs et la planification des configurations mémoire pour les systèmes IA. Le prix de la DDR5 au détail dépend d'un mélange plus large : demande de PC, stocks des revendeurs, prix contractuels et discipline des fournisseurs. Les faits ne montrent tout simplement pas d'effondrement sur ce segment.

L'argument contraire à court terme : la demande est déjà réservée

Il existe aussi une raison pratique de ne pas considérer la chute boursière comme une vérité établie.

Un porte-parole de Micron a déclaré que la capacité HBM4 de l'entreprise pour l'année entière est déjà épuisée via des contrats contraignants, incluant son premier accord client sur cinq ans. Cela n'infirme pas la thèse de l'efficacité logicielle, mais suggère que la demande à court terme reste extrêmement forte, en particulier pour la mémoire IA de haute valeur.

C'est le point que les marchés ont tendance à ignorer : une percée logicielle peut fragiliser le modèle de demande à long terme tout en laissant l'offre actuelle tendue et coûteuse. Les deux réalités peuvent coexister pendant un certain temps.

Confusion sur les dates et bruits de données

Un point mineur mais pertinent : même la chronologie des événements autour de TurboQuant a été floue.

Certains rapports citent le 25 mars comme date de sortie publique, alors que l'annonce de Google indique le 24 mars. On note aussi des incohérences dans certains tableaux de prix boursiers selon les sources. Rien de tout cela ne change le fond du problème, mais cela montre à quel point l'histoire a dépassé la rigueur des sources. C'est une raison supplémentaire de se méfier des affirmations péremptoires de « crash ».

Ce qu'il faut surveiller ensuite

Pour savoir si cette affaire deviendra un tournant réel pour le marché de la mémoire ou s'il s'agit d'une simple réaction excessive, quelques points clés seront déterminants.

Premièrement, l'implémentation officielle. Au 1er avril, Google n'avait publié aucune bibliothèque officielle pour TurboQuant. Les travaux communautaires sont utiles, mais un impact massif dépend de déploiements simplifiés et de benchmarks reproductibles.

Deuxièmement, la reproduction indépendante. Les chiffres de « 6x » ou « 8x » sont impressionnants, mais la question est de savoir ce qu'il en est dans des environnements d'inférence classiques, où les opérateurs utilisent déjà des techniques de basse précision.

Troisièmement, surveillez les commentaires sur la HBM et les configurations d'accélérateurs plutôt que les rayons de RAM pour PC. Si TurboQuant modifie les comportements d'achat, cela se verra d'abord dans la planification des infrastructures IA.

Enfin, ne confondez pas une vente massive d'actions avec une réinitialisation du marché final. Ce que le marché a fait, c'est intégrer le risque que le logiciel vienne grignoter les besoins matériels. Ce qu'il n'a pas montré, c'est une chute réelle des prix de la RAM ou une baisse démontrée de la demande mondiale.

Pour l'instant, la conclusion pratique est simple : TurboQuant semble assez important pour être surveillé de près, mais pas assez abouti pour clore le débat sur l'avenir du marché de la mémoire. Si ses promesses se confirment en production, les fournisseurs pourraient subir une pression accrue. Si le déploiement s'avère complexe, ou si la baisse des coûts stimule l'usage plus vite que la compression ne réduit le besoin par requête, la chute boursière actuelle pourrait sembler exagérée. Dans les deux cas, la prudence est de mise — mais le terme « crash » est, pour l'heure, inapproprié.

Commentaires