No universo acelerado da inteligência artificial, o GitHub Copilot tem sido apresentado como o maior exemplo de sucesso comercial. A Microsoft, sua empresa controladora, frequentemente exalta o assistente de codificação baseado em IA, afirmando que a ferramenta "reduziu o tempo de revisão de código", "aumentou a velocidade dos desenvolvedores" e impulsionou um crescimento de receita superior a 40% no quarto trimestre de 2024. Para muitos programadores, é inegável que a ferramenta se tornou um recurso valioso para gerar rapidamente códigos repetitivos (boilerplate), dados fictícios e testes, aliviando consideravelmente a carga mental.

No entanto, por trás dessa narrativa de progresso ininterrupto, uma inquietação crescente começa a surgir. Relatos em fóruns de desenvolvedores, Reddit, Hacker News e até de funcionários internos da Microsoft revelam um cenário complexo: embora o Copilot seja um acelerador potente, ele traz consigo desvantagens significativas. Talvez o indicador mais claro desses problemas subjacentes seja a postura cautelosa da própria Microsoft, que sugere que a empresa não está apostando todas as suas fichas apenas no Copilot.

O Lado Sombrio do Copilot: Quando a Velocidade Gera Volatilidade

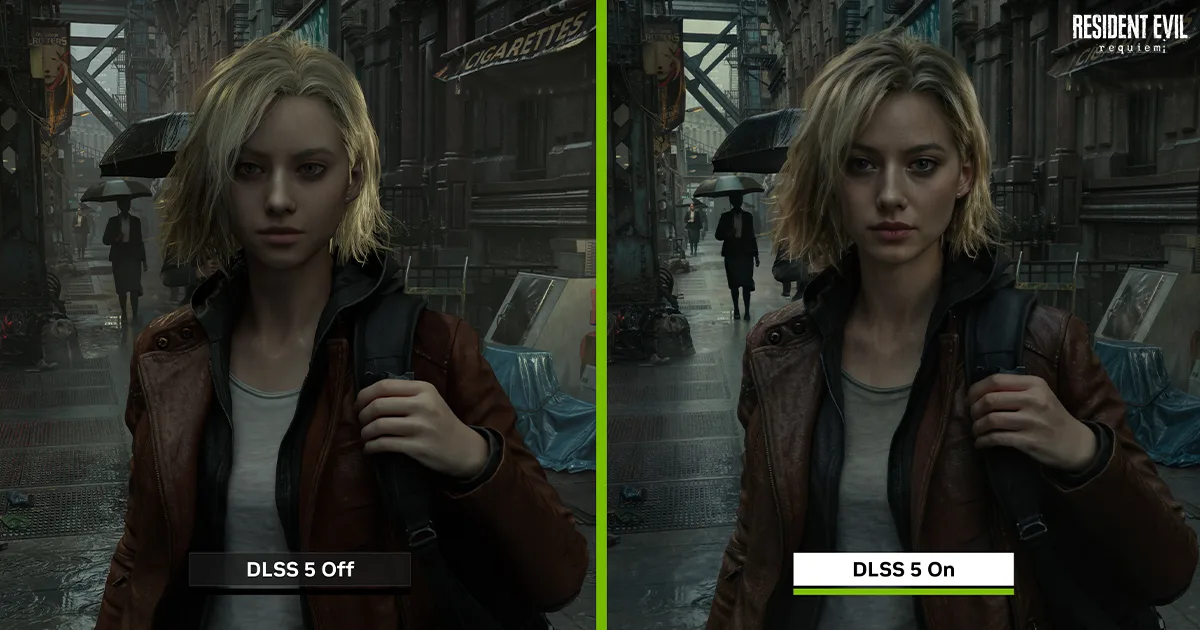

À primeira vista, as conquistas do Copilot impressionam. Trata-se de um serviço de IA construído sobre modelos fundamentais como o ChatGPT (e, historicamente, o Codex), projetado especificamente para tornar a programação mais rápida. O volume de código gerado por IA no setor é massivo; em abril de 2025, cerca de 30% da base de código da Microsoft era produzida por IA, um número que continua subindo e é acompanhado de perto pelas taxas de adoção do Google. Contudo, na TTEK2, questionamos a qualidade real por trás dessa expansão acelerada.

O consenso entre os desenvolvedores está longe de ser unânime:

- Alucinações e Dores de Cabeça: Usuários relatam com frequência que o Copilot "alucina APIs inteiras". Um comentário comum no Hacker News resume bem o sentimento: "O Copilot me economiza 30 minutos escrevendo código e me custa 2 horas depurando-o". Consideramos essa troca inaceitável para o desenvolvimento profissional sério.

- Falsa Sensação de Segurança: Um estudo publicado pela Microsoft, intitulado "A Falsa Sensação de Segurança na Programação em Par com IA", revelou um dado alarmante: desenvolvedores que revisam código gerado por IA deixam passar 40% mais bugs do que aqueles que revisam código escrito por humanos. A aparência "limpa" do código gerado por IA mascara erros sutis e insidiosos, promovendo uma perigosa "difusão de responsabilidade".

- Dependência e Estagnação do Desenvolvedor: A ferramenta pode incentivar uma dependência excessiva, um fenômeno descrito como "o autocomplete virando piloto automático". Discussões no Reddit sobre como o "Copilot me tornou preguiçoso" tornaram-se populares, levantando dúvidas se desenvolvedores iniciantes estão deixando de aprender conceitos fundamentais ao aceitar passivamente padrões de IA.

- Fadiga de Revisão de Código: Embora prometam velocidade, as sugestões do Copilot podem, paradoxalmente, inflar os pull requests. Equipes internas da Microsoft relataram que a presença de 60% a 70% de código gerado por IA fez com que o tamanho dos PRs saltasse de 200 para 700 linhas. Isso não é eficiência; é uma nova forma de fadiga cognitiva para os revisores.

- Pesadelos de Propriedade Intelectual (PI) e Privacidade: O aspecto mais preocupante é o aviso de isenção da Microsoft: ela não garante a correção do código produzido, nem assume responsabilidade por conformidade de licença ou varredura de PI. Matthew Butterick, que move uma ação coletiva contra a legalidade do Copilot, descreve-o como um "buraco negro de direitos de PI". Além disso, o fato de o Copilot atuar tecnicamente como um keylogger, transmitindo o que é digitado para a Microsoft, cria riscos para segredos comerciais. O uso dessas ferramentas pode levar à "contaminação não intencional com violações de licença", o que consideramos um sinal de alerta vermelho para qualquer empresa.

Desenvolvedores internos da Microsoft chegaram a rotular pull requests gerados por IA como "Síndrome de Estocolmo como Serviço", enquanto usuários externos foram mais diretos, chamando a ferramenta de "um desastre absoluto até para a lógica mais básica". Não são exatamente elogios de uma base de usuários confiante.

Nos Bastidores: Por que a Microsoft Aposta em Rivais

Diante desses desafios, a Microsoft demonstra um pragmatismo surpreendente. Em vez de defender exclusivamente o Copilot, a gigante da tecnologia está explorando ativamente alternativas internas.

No ano passado, a divisão de desenvolvedores da Microsoft realizou um experimento comparando várias ferramentas de codificação por IA. Essa avaliação interna incluiu o GitHub Copilot, o GPT-5 da OpenAI e o Claude 4 da Anthropic. O feedback desse processo será crucial para definir a estratégia dos modelos que sustentam o Copilot no futuro.

O ponto mais revelador é que a Microsoft está testando internamente o Claude Code, da Anthropic, lado a lado com o Copilot. O Claude Code tem recebido elogios significativos; desenvolvedores sentem que ele resolve problemas de forma mais eficaz, mesmo quando não lidera os benchmarks técnicos. Sua "janela de contexto maior" e estilo de codificação limpo impressionaram até Jensen Huang, CEO da Nvidia, que o chamou de "incrível". A Microsoft até encorajou funcionários de sua divisão 'Experiences + Devices' a experimentar o Claude, mesmo aqueles sem experiência prévia em programação.

Resumimos as principais diferenças e o sentimento dos desenvolvedores na tabela abaixo:

Embora a versão empresarial do Claude Code seja muito mais cara, sua capacidade superior de resolução de problemas mostra que a Microsoft vê valor em alternativas, especialmente para tarefas onde a confiabilidade é primordial.

A Jogada de Mestre do Azure: Hospedando o Ecossistema de IA

Os testes da Microsoft com modelos concorrentes não devem ser vistos como um recuo, mas como um movimento calculado para consolidar o Azure como a plataforma de nuvem definitiva para todos os modelos de IA.

Em novembro de 2025, Microsoft, Anthropic e Nvidia anunciaram uma parceria estratégica. O investimento de US$ 5 bilhões da Microsoft na Anthropic e o compromisso da Anthropic de comprar US$ 30 bilhões em serviços de computação do Azure destacam uma relação simbiótica. Embora a OpenAI continue sendo a principal parceira para modelos de fronteira, a Microsoft mantém um relacionamento de US$ 500 milhões por ano com a Anthropic. Para selar isso, as equipes de vendas do Azure agora recebem crédito de cota pela venda de modelos da Anthropic.

Essa estratégia multiparceiros é evidenciada pelo "Microsoft Foundry for Visual Studio Code", uma plataforma que oferece acesso a um catálogo de modelos da Microsoft, OpenAI, Meta e DeepSeek. Os clientes do Foundry podem acessar o Claude Sonnet, Opus e Haiku através de acordos com a Anthropic.

Ao oferecer diversos modelos líderes via Azure, a Microsoft protege suas apostas. Independentemente de qual ferramenta de IA domine o mercado, ela provavelmente rodará na infraestrutura de nuvem da Microsoft. É uma jogada de longo prazo para tornar o Azure indispensável, não importa quem vença a guerra dos modelos.

O Futuro Inevitável: Navegando no Campo Minado da Programação com IA

A mudança para o código gerado por IA é uma maré irreversível. No entanto, os desafios destacados pela própria Microsoft são urgentes:

- Qualidade e Confiança: A natureza não determinística da IA e os avisos sobre bugs ignorados significam que a confiança no código gerado não pode ser automática. A dificuldade de "depurar as suposições de um modelo sobre sua lógica" torna seu uso em sistemas críticos uma preocupação.

- Propriedade Intelectual e Auditabilidade: O imbróglio jurídico sobre direitos de PI e a falta de uma "cadeia de custódia" clara entre os dados de treinamento e a saída gerada continuam sendo grandes obstáculos para empresas que protegem códigos proprietários.

- O Elemento Humano: Existe o risco de perda do "artesanato" de software se os desenvolvedores se tornarem meros editores de saídas de IA. A capacidade dos novos programadores de dominar conceitos fundamentais em vez de apenas copiar e colar é uma questão que exige atenção.

Um Pivô Pragmático: Equilibrando Velocidade e Sanidade

Os testes internos da Microsoft revelam uma compreensão clara das limitações atuais da IA. Embora o GitHub Copilot tenha cumprido a promessa de velocidade e receita, os problemas de precisão e conformidade estão forçando a empresa a diversificar.

Não se trata de substituir o Copilot, mas de garantir que o modelo de IA correto seja usado para o trabalho correto, com o Azure servindo como a base unificadora. A exploração de alternativas como o Claude Code sinaliza um pivô pragmático: o reconhecimento de que a busca incessante por velocidade deve ser equilibrada com os imperativos de qualidade, segurança e confiança do desenvolvedor. O setor estará observando como a Microsoft navegará nessas águas para oferecer soluções que sejam não apenas rápidas, mas fundamentalmente responsáveis.

Comentários