La feroz competencia por alimentar la explosiva infraestructura de inteligencia artificial en todo el mundo está alcanzando su punto álgido. Durante años, la memoria de alto ancho de banda (HBM) ha reinado como la opción predilecta para los aceleradores de IA de vanguardia. Sin embargo, estamos presenciando la aparición de un nuevo estándar de memoria, SOCAMM2, que promete redefinir las reglas del juego. A medida que avanzamos hacia principios de 2026, los rumores de la industria sugieren que gigantes del silicio como AMD y Qualcomm están listos para integrar SOCAMM2 en sus próximas líneas de productos de IA. Este movimiento marca un cambio significativo, con el objetivo de transformar la capacidad de memoria, la eficiencia energética y la economía de los sistemas a largo plazo dentro del altamente competitivo mercado de centros de datos de IA.

El cuello de botella de la memoria en la IA: Se vuelve personal

Durante demasiado tiempo, la potencia computacional bruta de los aceleradores de IA acaparó todos los titulares. No obstante, desde nuestra perspectiva, el verdadero cuello de botella del hardware para la IA está evolucionando rápidamente de los FLOPs brutos a la memoria. La proliferación de modelos de lenguaje de gran tamaño (LLM) y modelos multimodales complejos (MMM) ha creado una demanda insaciable de una capacidad de memoria inmensa, una eficiencia energética excepcional y arquitecturas escalables. Estos modelos requieren cantidades de datos sin precedentes alojados "cerca" de las unidades de procesamiento, no solo para las fases iniciales de entrenamiento, sino, quizás de manera más crítica, para la inferencia: la operación diaria de los modelos de IA en aplicaciones del mundo real.

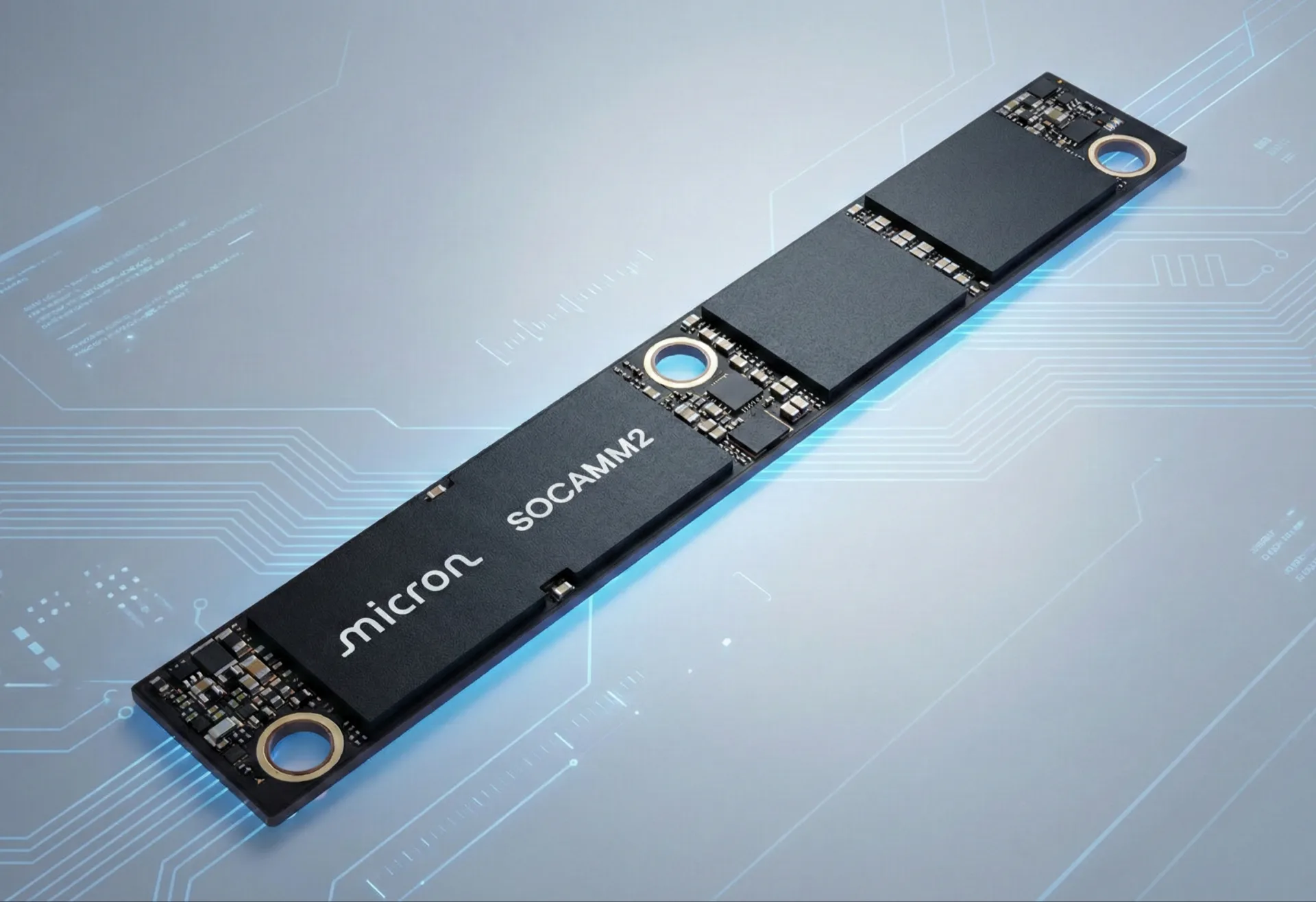

NVIDIA, una empresa que domina más del 90% del mercado de chips de IA, no llegó a esto por casualidad. Ellos fueron pioneros en el concepto de Módulo de Memoria Avanzada de Sistema en Chip (SOCAMM), impulsando el estándar SOCAMM2 con un amplio respaldo de la industria e integrándolo en sus aceleradores Vera Rubin. Aunque se informa que la primera incursión de NVIDIA con SOCAMM1 enfrentó varios obstáculos técnicos que obligaron a un rediseño significativo para SOCAMM2, su compromiso continuo subraya la importancia percibida del estándar. Ahora, parece que AMD y Qualcomm siguen sus pasos, no solo adoptando el estándar, sino explorando implementaciones únicas que podrían definir sus propios nichos competitivos.

SOCAMM2: Un nuevo espacio de trabajo activo para la IA

Consideramos que SOCAMM2 es un paso evolutivo crucial en el despliegue de memoria. Efectivamente, cierra la brecha entre la memoria LPDDR (Low Power Double Data Rate) soldada tradicional, común en dispositivos móviles, y los DIMMs de servidor con zócalo, que a menudo son menos eficientes energéticamente. Posicionado estratégicamente entre la memoria HBM (ultrarrápida pero de capacidad limitada) y la DRAM convencional del sistema, SOCAMM2 establece un nuevo "Espacio de Trabajo Activo" o "pool de memoria de proximidad" diseñado específicamente para agentes de IA.

A continuación, explicamos por qué SOCAMM2 es relevante:

- Modular y Intercambiable: A diferencia de la memoria LPDDR soldada permanentemente, los módulos SOCAMM2 son desmontables. Esto no es solo una conveniencia menor; para los centros de datos, es un factor crítico para la longevidad de la plataforma, permitiendo actualizaciones más sencillas, reemplazos y una mayor capacidad de servicio. Creemos que esto mejora drásticamente el coste total de propiedad (TCO) a lo largo del tiempo.

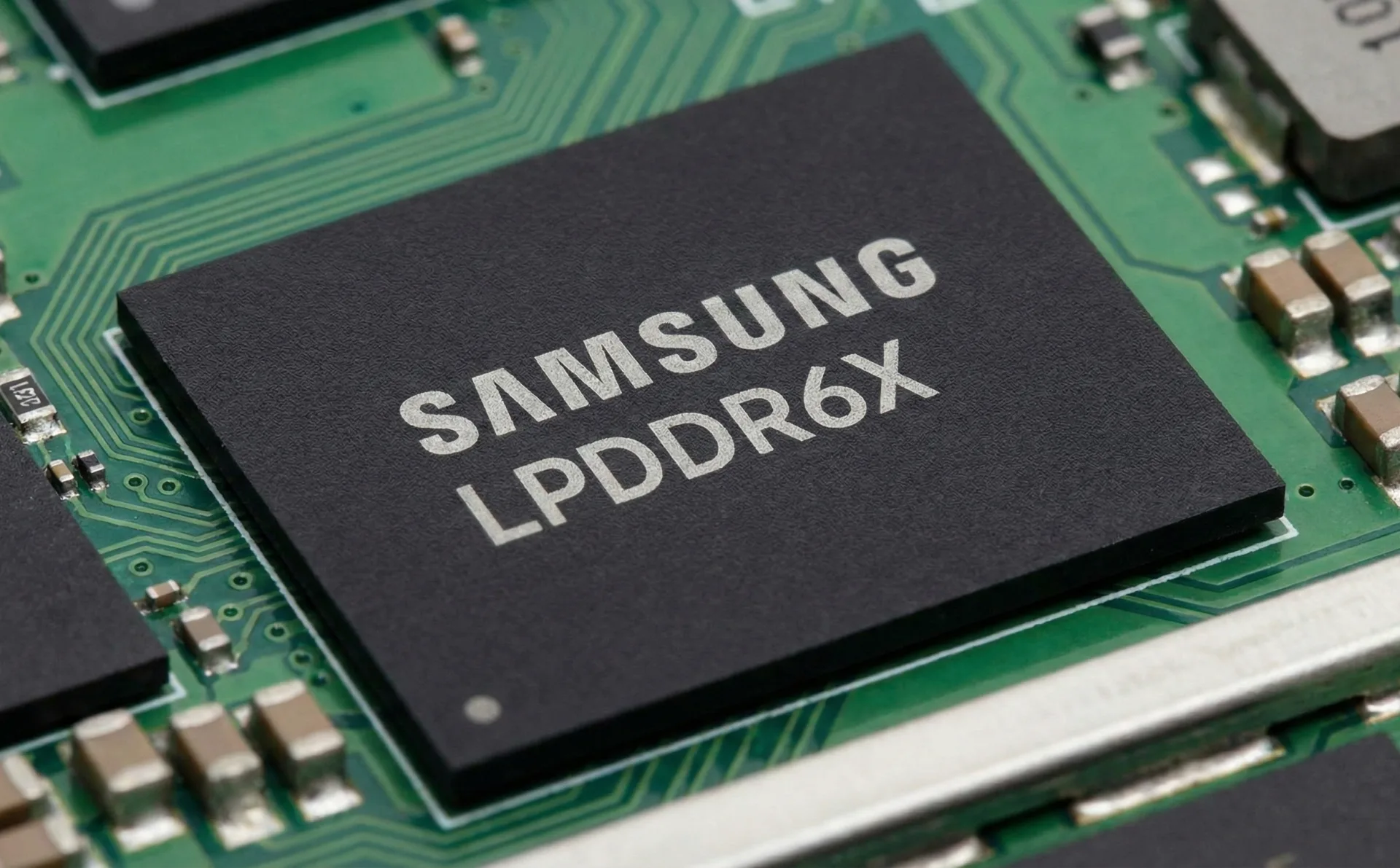

- Basado en LPDDR: Aprovechando LPDDR5X hoy y con LPDDR6 en el horizonte, SOCAMM2 se beneficia de una tecnología intrínsecamente eficiente. LPDDR6, en particular, promete no solo un ancho de banda significativamente mayor (un proyectado de 38,4 GB/s por canal), sino también un consumo de energía aproximadamente un 20% menor que LPDDR5X, un detalle crucial para las operaciones de IA a hiperescala.

- Alta Capacidad y Ancho de Banda: Estos módulos no se quedan atrás; Micron ya está enviando muestras de unidades de hasta 192 GB. En sistemas como el NVIDIA GB300 NVL72, el SOCAMM2 basado en LPDDR5X puede contribuir con unos asombrosos 18 TB de memoria con un ancho de banda de sistema de aproximadamente 16 TB/s. Incluso los módulos individuales ofrecen velocidades de transferencia de 9,600 MT/s, entregando el doble de ancho de banda que los RDIMMs DDR5 tradicionales.

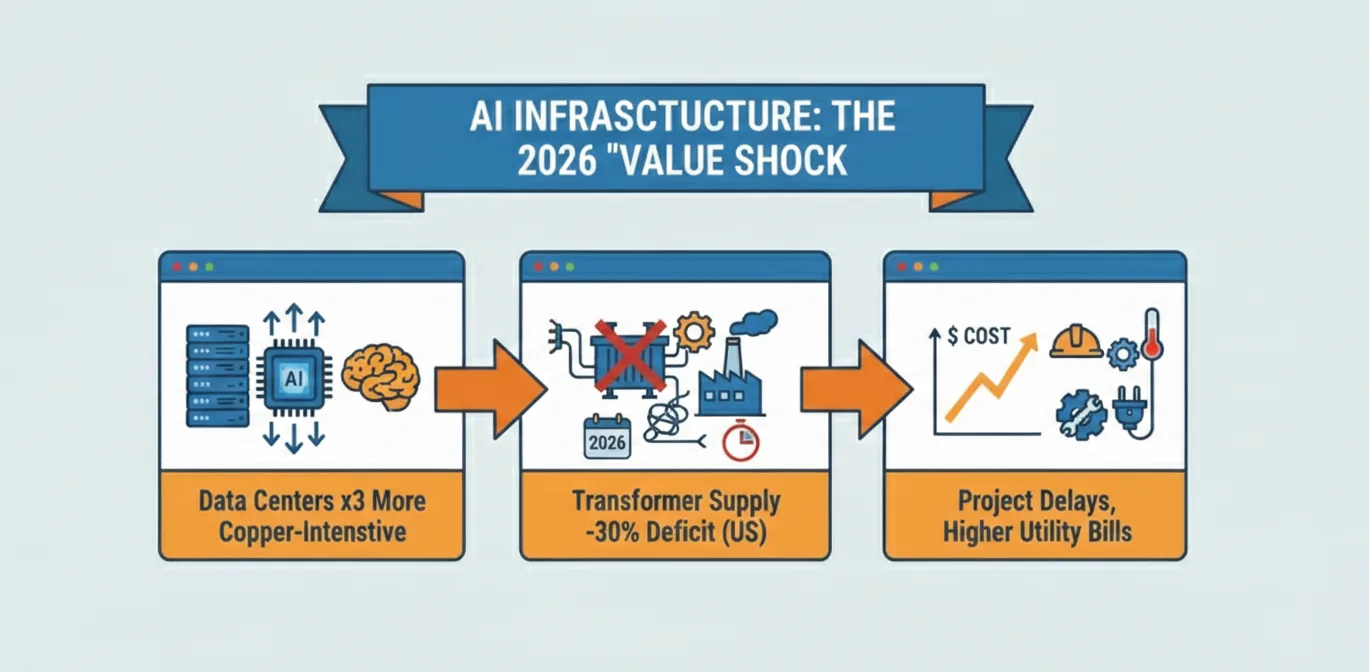

- Eficiencia Energética: Al adoptar la tecnología LPDDR, SOCAMM2 consume intrínsecamente menos energía que los RDIMMs basados en DRAM estándar. Esto es absolutamente crítico para despliegues masivos de IA donde cada vatio contribuye significativamente a los crecientes costes energéticos.

- Diseño Compacto: Su diseño simplifica el enrutamiento de la placa y la refrigeración en sistemas densos, una necesidad para los sistemas de IA a escala de rack que dominan el mercado.

- Estándar JEDEC: La expectativa de que SOCAMM2 cumpla con la norma JEDEC JESD328 es vital. Esto garantiza la intercambiabilidad y la neutralidad del proveedor, lo que anticipamos fomentará una cadena de suministro más saludable y competitiva, evitando que un solo fabricante dicte las condiciones.

En esencia, SOCAMM2 permite que los modelos de IA retengan millones de tokens y estados persistentes directamente dentro del "pool de memoria de proximidad" del acelerador, reduciendo drásticamente el tráfico entre nodos y aumentando la eficiencia general del sistema. Aunque se reconoce que su rendimiento es más lento que el de la HBM y la latencia puede ser mayor que la de la DDR5 estándar, creemos que estas limitaciones a menudo se exageran. Para las demandas de rendimiento continuo y sostenido de muchas cargas de trabajo de IA, especialmente en inferencia, estos factores suelen amortizarse y quedar eclipsados por las ventajas de capacidad y consumo.

La audaz apuesta de Qualcomm por el dominio de la inferencia

Qualcomm, veterano de los procesadores móviles, entró oficialmente en la escena de los centros de datos de IA el 27 de octubre de 2025 con la presentación de sus aceleradores de inferencia AI200 y AI250. Estos chips, programados para su venta en 2026 (AI200) y 2027 (AI250), son un desafío directo para NVIDIA y AMD, con un enfoque láser en la inferencia de IA para LLMs y MMMs.

La estrategia de Qualcomm, según nuestro análisis, se basa en varios pilares fundamentales:

- Eficiencia Energética y TCO: Con un consumo de energía declarado por sistema de rack de 160 kW para sus soluciones refrigeradas por líquido, Qualcomm prioriza un bajo coste total de propiedad. Esto se alinea perfectamente con las ventajas energéticas derivadas de LPDDR en SOCAMM2. Consideramos que es una jugada inteligente, ya que los costes energéticos son una preocupación principal para los operadores de centros de datos.

- Capacidad Masiva de LPDDR: Las tarjetas AI200 y AI250 están diseñadas para albergar hasta 768 GB de memoria LPDDR cada una. Esta inmensa capacidad es ideal para manejar las gigantescas ventanas de contexto y los parámetros de los modelos de IA modernos, entregando potencialmente lo que Qualcomm afirma ser "más capacidad de memoria por menos dinero" que sus competidores. Estamos ansiosos por ver si esta afirmación se mantiene en despliegues reales.

- Arquitectura de Memoria Innovadora: El AI250, en particular, presume de un diseño de "computación cerca de la memoria". Qualcomm afirma que esto ofrece un "salto generacional en eficiencia y rendimiento" y un "ancho de banda de memoria efectivo más de 10 veces superior" en comparación con las GPUs actuales de NVIDIA, junto con un consumo de energía significativamente menor. Aunque son afirmaciones ambiciosas, tal arquitectura se beneficiaría innegablemente de la capacidad de SOCAMM2 para actuar como un "Espacio de Trabajo Activo" localizado. Mantenemos cierto escepticismo sobre las promesas de "10 veces más" hasta que surjan pruebas de rendimiento independientes, pero la dirección es clara.

- Sistemas a Escala de Rack: Qualcomm no solo vende chips; sus ofertas se presentan como sistemas completos de racks de servidores refrigerados por líquido, capaces de orquestar hasta 72 chips como una sola computadora. Esto iguala la escala y la ambición de las soluciones de rack de NVIDIA y AMD.

- Integración Única de PMIC: Informes indican que Qualcomm, junto con AMD, está explorando un diseño de módulo SOCAMM que incorpora la gestión de energía (PMIC) directamente en el módulo. Este diseño, que presenta módulos de forma cuadrada con cuatro chips DRAM, simplifica la fabricación de la placa del sistema y permite un control de voltaje más estricto, algo crítico para mantener la integridad de la señal a las altas tasas de datos de LPDDR5X/LPDDR6. Este enfoque innovador podría ofrecer una ventaja tangible en fiabilidad y rendimiento.

La temprana asociación de Qualcomm con Humain de Arabia Saudí, comprometiéndose a desplegar sistemas utilizando hasta 200 megavatios de potencia a partir de 2026, demuestra una tracción real en el mercado para su enfoque centrado en la inferencia y con gran uso de LPDDR. No es solo una propuesta teórica; es una inversión concreta.

La posición estratégica de AMD y la sombra de OpenAI

Aunque los planes específicos de adopción de SOCAMM2 por parte de AMD son menos detallados que los de Qualcomm en esta etapa, los informes sugieren que también lo están integrando en sus próximas líneas de productos de IA. Esto tiene un sentido estratégico inmenso dada su competencia directa con NVIDIA. AMD ya posee una sólida cartera de CPUs y GPUs de servidor para IA, e integrar SOCAMM2 mejoraría innegablemente su capacidad de memoria y sus ofertas de velocidad, un diferenciador crucial para un rendimiento competitivo.

Anticipamos que el interés de AMD refleja el de Qualcomm: aprovechar LPDDR para una eficiencia energética superior y una mayor capacidad. Ellos también podrían adoptar el diseño de PMIC en el módulo por beneficios similares. El panorama competitivo más amplio también es significativo. Los informes sobre los planes de OpenAI de no solo comprar chips de AMD, sino potencialmente tomar una participación en la empresa, podrían proporcionar a AMD un impulso considerable en el mercado de chips de IA, aumentando la presión sobre el dominio aparentemente inexpugnable de NVIDIA. Creemos que esta potencial alianza podría ser un verdadero acelerador para AMD, desafiando la narrativa del duopolio en el hardware de IA.

Implicaciones más amplias: Un enfrentamiento en el centro de datos

La adopción prevista de SOCAMM2 por parte de AMD y Qualcomm señala un movimiento unido de la industria hacia soluciones de memoria optimizadas para el mercado de IA en explosión. Con el valor del submercado de servidores de IA proyectado para dispararse a 298.000 millones de dólares para 2025, representando más del 70% de la industria total de servidores, lo que está en juego no podría ser más importante.

Sin embargo, este cambio no está exento de obstáculos:

- Gestión Térmica: Empaquetar numerosos dispositivos LPDDR en un módulo compacto crea inevitablemente desafíos significativos de densidad de calor. Creemos que la durabilidad térmica sigue siendo una preocupación clave para los chips de IA basados en LPDDR. La refrigeración líquida directa está evolucionando rápidamente de una solución de nicho a una necesidad fundamental.

- Desarrollo y Costes de LPDDR6: Aunque es prometedor, LPDDR6 todavía se encuentra en la etapa de verificación técnica. Persisten las incertidumbres sobre la compatibilidad, los costes de producción en masa y la estabilidad a largo plazo tras su aplicación a gran escala. La industria necesita que LPDDR6 se materialice de manera eficiente para que SOCAMM2 alcance su pleno potencial.

- Obstáculos de Comercialización: La alta velocidad de transferencia de SOCAMM2 y sus conjuntos de instrucciones especializados pueden requerir actualizaciones de hardware para los controladores de memoria de servidores más antiguos, lo que podría crear una curva de adopción más lenta para algunos actores. Además, los costes de I+D y fabricación de los módulos SOCAMM2, en comparación con la DDR5 tradicional, significan que su verdadera propuesta de valor reside en la economía total del sistema más que en el precio del módulo individual.

- El Efecto de Red de NVIDIA: El desafío más significativo para cualquier nuevo competidor de chips de IA sigue siendo el formidable ecosistema de software CUDA de NVIDIA. Esta plataforma profundamente arraigada crea un poderoso efecto de "lock-in" para los desarrolladores y la infraestructura existente. Junto con esto, asegurar la compatibilidad técnica con las herramientas de orquestación existentes será crítico para que AMD y Qualcomm logren atraer a los clientes fuera del incumbente.

A pesar de estos desafíos, el impulso de múltiples proveedores detrás de SOCAMM2 —incluyendo a NVIDIA, Samsung, SK Hynix, Micron y Foresee (con una versión personalizada para el mercado chino)— indica una fuerte creencia colectiva en su potencial a largo plazo. Aunque no se espera disponibilidad masiva de SOCAMM2 hasta principios de 2027, las bases que están sentando Qualcomm y AMD a principios de 2026 preparan indudablemente el escenario para una reorganización dramática de la jerarquía de la memoria de IA.

Creemos que SOCAMM2 está estableciendo los cimientos para una base más sostenible, escalable y fácil de mantener para el futuro impulsado por la IA. A medida que el centro de datos de IA continúa su rápida expansión, la lucha por el dominio de la memoria, que ahora cuenta con SOCAMM2, sin duda dará forma a la próxima generación de inteligencia artificial.

Comentarios