La frase que ha ganado tracción esta semana — "Google TurboQuant RAM price crash" (el desplome de precios de la RAM por TurboQuant de Google) — incurre en dos errores fundamentales.

En primer lugar, TurboQuant no es un producto de memoria RAM. Se trata de un algoritmo de compresión desarrollado por Google Research, anunciado el 24 de marzo de 2026 mediante una publicación de blog y un artículo técnico, con detalles adicionales presentados en la cumbre AI at Scale el 30 de marzo. Google lo describe como un método para comprimir el caché KV utilizado durante la inferencia de modelos de lenguaje de gran tamaño (LLM) y, de forma más general, como una técnica de cuantificación vectorial para cargas de trabajo que consumen mucha memoria. Según la propia documentación de Google, el objetivo es atacar uno de los mayores cuellos de botella de la inferencia: la sobrecarga de memoria, especialmente cuando las ventanas de contexto crecen. El anuncio original se encuentra en el blog de Google Research, y diversos resúmenes externos lo han enfocado de manera similar, incluyendo a TechInformed.

En segundo lugar, los precios de la memoria DDR5 para consumo no se han desplomado. Al 1 de abril, los precios minoristas de la DDR5 en EE. UU. se asemejan más a una meseta que a un colapso. Un kit de 2x16GB DDR5-6000 CL30 promedió $529, apenas ligeramente por debajo del rango de $535–$550 observado a finales de marzo. Esto coincide con el seguimiento de precios de RAM de Tom's Hardware y el análisis de mercado de DropReference.

Lo que sí ocurrió fue un movimiento más específico, pero significativo: las acciones de semiconductores relacionados con la memoria sufrieron una fuerte venta masiva tras el anuncio de Google y el debate posterior.

Lo que realmente se movió

Las operaciones de finales de marzo muestran una clara reacción del mercado, a pesar de que la etiqueta de "colapso de la RAM" sea imprecisa.

Micron fue la más afectada en la liquidación estadounidense. En dos días, la compañía cayó más de un 14–15%, perdiendo más de $25 mil millones en valor de mercado, con una caída que se intensificó el 30 y 31 de marzo, provocando múltiples suspensiones de cotización. Western Digital bajó entre un 11 y 13%, Seagate cayó cerca de un 9%, y el impacto se extendió a Asia: SK Hynix descendió un 6.2–6.4% el 26 de marzo, Samsung Electronics cayó aproximadamente un 4.7% y Kioxia retrocedió casi un 6%. CNBC captó la esencia de este movimiento regional al informar que las empresas de memoria de Corea del Sur y Kioxia cayeron después de que el anuncio de software de Google asustara a los inversores sobre la demanda futura de memoria.

Esto no demuestra que TurboQuant vaya a reducir materialmente la demanda de memoria, pero sí evidencia que los operadores lo consideraron una amenaza lo suficientemente creíble —o al menos una razón válida para reevaluar expectativas muy optimistas.

Qué promete TurboQuant y por qué les importó a los inversores

Las afirmaciones principales de Google son la razón por la cual esto se difundió tan rápido.

TurboQuant se describe como capaz de reducir el uso de memoria del caché KV en al menos 6 veces y ofrecer aceleraciones de hasta 8 veces en ciertas cargas de trabajo de atención. El documento técnico explica que el sistema combina métodos de PolarQuant con técnicas de Quantized Johnson-Lindenstrauss (QJL). Diversos análisis de la comunidad han resumido la propuesta en términos prácticos: comprimir el caché KV a aproximadamente 3–4 bits por elemento sin necesidad de reentrenamiento o ajuste fino en las configuraciones probadas, como se señala en un resumen orientado a desarrolladores en Dev.to.

Esto es relevante porque el caché KV representa un centro de costes real en la inferencia. Si un modelo puede mantener más contexto en menos memoria, los operadores podrían ejecutar cargas de trabajo más grandes en la misma infraestructura de aceleradores, albergar más sesiones por GPU o evitar la transición a configuraciones de memoria de mayor capacidad tan pronto como se preveía. En teoría, la eficiencia del software puede socavar la demanda de hardware.

Esa es la teoría que provocó la venta por parte de los inversores.

El matiz: las cifras de los titulares no equivalen a la realidad implementada

Aquí es donde el análisis debe volverse un poco más técnico, porque los detalles importan.

El texto de la investigación disponible incluye varias advertencias:

Estas advertencias son más importantes de lo que sugiere la versión viral de la historia. Un resultado de laboratorio enfocado en la compresión de caché KV no se traduce automáticamente en una reducción generalizada de toda la demanda de memoria. Podría ser valioso para ciertas cargas de inferencia, apenas relevante para otras y difícil de operativizar a gran escala hasta que las herramientas mejoren.

Un medio comparó la reacción en línea con una broma sobre la serie Silicon Valley de HBO y la empresa Pied Piper, pero MakeMeTechie aportó el punto más útil: por ahora, sigue siendo un resultado en fase de laboratorio.

¿Por qué el mercado vendió primero?

Incluso con toda esa incertidumbre, la liquidación no fue irracional. Fue rápida, pero no sin fundamentos.

Muchas empresas de memoria habían estado cotizando bajo la premisa de que la inferencia y el entrenamiento de IA mantendrían a todo el sector en un ciclo alcista prolongado de demanda. TurboQuant golpeó un punto débil de esa narrativa: ¿qué pasa si el software empieza a reducir la cantidad de memoria que cada consulta o cada modelo desplegado realmente necesita?

Así es como lo plantearon varios analistas:

El analista de Morgan Stanley, Shawn Kim, argumentó que, si bien TurboQuant podría reducir el uso de memoria por consulta, también podría desencadenar un efecto de la paradoja de Jevons: abaratar la inferencia podría aumentar tanto el uso total de la IA que la demanda agregada de memoria termine subiendo. Bajo esta lectura, TurboQuant no es necesariamente negativo para la memoria a largo plazo; simplemente podría desplazar la curva de costes y permitir más despliegues locales o de bajo coste.

Andrew Rocha, analista de Wells Fargo, tomó la preocupación de forma más directa, afirmando que TurboQuant ataca la curva de costes de la inferencia de IA y plantea dudas sobre cuánta capacidad de memoria será necesaria realmente a largo plazo si las especificaciones de los sistemas disminuyen.

Peter Callahan, analista de Goldman Sachs, describió el movimiento como un "ajuste de realidad" más que un pánico, con inversores reevaluando si el superciclo de la memoria puede sobrevivir a ganancias de eficiencia significativas impulsadas por el software.

Varios bancos de primer nivel también rebajaron la calificación del sector de memoria de "Sobreponderar" a "Neutral", citando un posible cambio estructural en el gasto de capital (capex) de IA hacia la optimización de software en lugar de la acumulación de hardware.

Este conjunto de opiniones ayuda a explicar por qué una publicación en un blog de investigación pudo borrar decenas de miles de millones en valor bursátil. El mercado no estaba descontando un colapso verificado en la demanda de DRAM, sino la posibilidad de que las suposiciones de crecimiento máximo fueran demasiado optimistas.

Por qué esto no trata realmente sobre la DDR5 de escritorio

Una razón por la que el titular del "colapso de la RAM" es engañoso es que mezcla varios mercados muy distintos en una sola categoría.

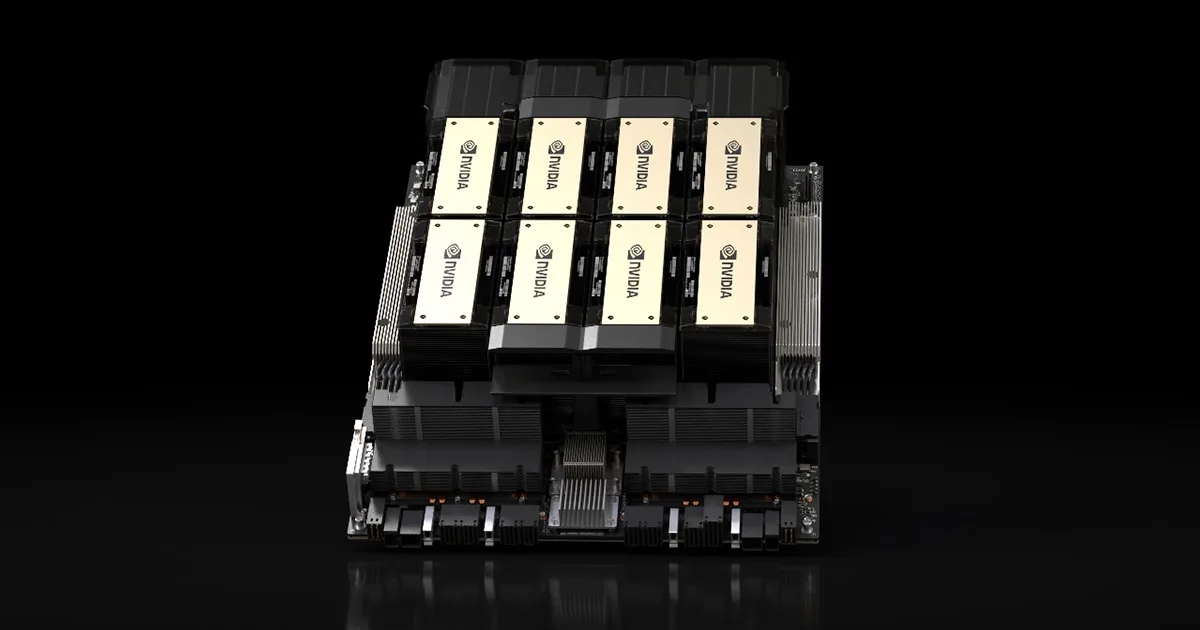

TurboQuant se discute principalmente en el contexto de la inferencia de IA, especialmente en torno a la presión de memoria en las GPU y el caché KV. Las referencias de rendimiento apuntan a aceleradores de clase NVIDIA H100 y B200, con trabajos de la comunidad que también tocan entornos de CPU y Apple Silicon. Eso no equivale a decir que los módulos DIMM DDR5 ordinarios para computadoras de escritorio deban abaratarse de repente.

Incluso si TurboQuant resulta útil, el efecto de primer orden se vería probablemente en la economía de la inferencia en servidores, la utilización de aceleradores y la planificación de configuraciones de memoria para sistemas de IA. El precio minorista de la DDR5 depende de una mezcla más amplia de demanda de PC, inventario en canales, precios de contratos y disciplina de los proveedores. Los hechos actuales simplemente no muestran un colapso minorista.

El contraargumento a corto plazo: la demanda ya está reservada

También hay una razón práctica para no interpretar el movimiento de las acciones como un hecho consumado.

Un portavoz de Micron afirmó que la capacidad de HBM4 de la compañía para todo el año está agotada bajo contratos vinculantes, incluyendo su primer acuerdo con un cliente a cinco años. Esto no refuta la tesis de la eficiencia por software, pero sugiere que la demanda a corto plazo sigue siendo sólida, especialmente en los niveles de memoria de IA de mayor valor.

Esta es la parte que los mercados suelen simplificar en una sola historia. Un avance de software puede presionar el modelo de demanda a largo plazo mientras mantiene la oferta actual ajustada, respaldada por contratos y costosa. Ambas realidades pueden coexistir durante un tiempo.

Confusión en las fechas y ruido en los datos

Un punto menor pero relevante: incluso la cobertura del cronograma básico de TurboQuant ha sido algo desordenada.

Algunos informes y resúmenes secundarios mencionan el 25 de marzo como la fecha de lanzamiento público, mientras que el anuncio de Google y los materiales verificados apuntan al 24 de marzo. También existen inconsistencias en algunas tablas de precios de acciones y cifras de "antes y después" en diferentes agregadores. Nada de esto cambia el panorama central, pero refuerza lo rápido que esta historia superó a las fuentes de información precisas.

Esa es otra razón para ser cautelosos con las afirmaciones radicales sobre un "colapso".

Qué observar a continuación

Si está tratando de determinar si esto se convertirá en una historia real del mercado de memoria o simplemente en una reacción exagerada, hay algunos factores que importan más que los eslóganes.

Primero, la implementación oficial es clave. Al 1 de abril, Google no había lanzado una librería oficial de código abierto ni una integración de producción. El trabajo de la comunidad es útil, pero el impacto generalizado suele depender de implementaciones sencillas y resultados comparativos (benchmarks) repetibles.

Segundo, la reproducción independiente importa más que los máximos de un blog. Las cifras de "hasta 8x" y "6x" llaman la atención, pero la pregunta real es qué sucede bajo configuraciones de inferencia comunes, especialmente donde los operadores ya utilizan técnicas de baja precisión.

Tercero, preste más atención a los comentarios sobre HBM y configuraciones de aceleradores que a los estantes de RAM de escritorio. Si TurboQuant cambia el comportamiento de compra, es más probable que se refleje primero en la planificación de infraestructura de IA que en los precios de los módulos DIMM para el consumidor.

Finalmente, no confunda una venta masiva de acciones con un reajuste confirmado del mercado final. Lo que el mercado ha hecho claramente es ajustar los precios ante la posibilidad de que el software pueda devorar las suposiciones de hardware. Lo que no ha mostrado, al menos todavía, es un colapso literal en los precios de la RAM o una caída demostrada en la demanda de memoria en el mundo real.

Por ahora, la conclusión práctica es directa: TurboQuant parece lo suficientemente importante como para monitorearlo, pero no lo suficientemente definitivo como para cerrar el debate sobre la memoria. Si las promesas se mantienen en entornos de producción, los proveedores de memoria podrían enfrentar más presión sobre la pregunta de "¿cuánta capacidad es suficiente?". Si el despliegue resulta complicado, o si una inferencia más barata expande el uso más rápido de lo que la compresión reduce la memoria por consulta, la venta masiva actual podría parecer exagerada. La evidencia hasta ahora respalda la cautela en ambos sentidos — simplemente no justifica la frase "colapso del precio de la RAM".

Comentarios