Durante meses, el mundo tecnológico ha sido testigo de una tensa partida de ajedrez geopolítico, con los avanzados chips de IA Nvidia H200 en el centro del tablero. Ahora, según los informes, China ha dado luz verde a las primeras importaciones significativas de estos potentes procesadores; un movimiento que consideramos un giro pragmático de Pekín, nacido más de una necesidad inmediata que de un cambio en su postura sobre la autosuficiencia tecnológica. Las autorizaciones iniciales cubren más de 400.000 chips H200, con gigantes como ByteDance, Alibaba y Tencent posicionados para beneficiarse de esta inyección crucial de potencia de procesamiento.

Este cambio de política, que coincide con la visita del CEO de Nvidia, Jensen Huang, a China a finales de enero, proporciona un respiro muy necesario, aunque potencialmente temporal, para un sector tecnológico chino cuyos ambiciosos planes de despliegue de IA se han visto obstaculizados por la incertidumbre en las importaciones. Huang llegó a Shanghái el viernes 23 de enero para las celebraciones anuales con los empleados de Nvidia en China, antes de viajar a Pekín y otras ciudades.

¿Por qué China no podía permitirse esperar? La ventaja crítica del H200

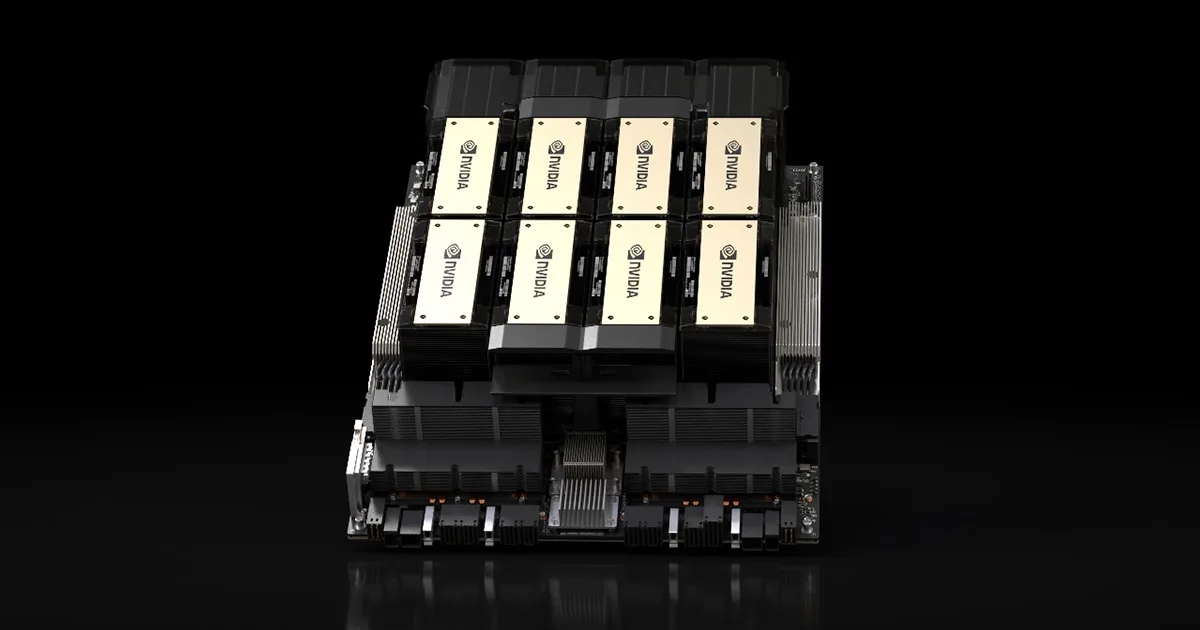

El Nvidia H200 no es un chip cualquiera; es una pieza fundamental para el desarrollo de IA a gran escala. Diseñado específicamente para entrenar y ejecutar modelos masivos de IA en centros de datos, se posiciona como el segundo procesador de IA más potente del mundo, ofreciendo un salto de rendimiento crítico para las cargas de trabajo más exigentes. Consideramos esto como un reconocimiento claro por parte de China de que sus alternativas nacionales, aunque progresan, simplemente no están listas para competir a este nivel. El H200 supera significativamente a los chips más antiguos disponibles anteriormente en China, incluido el propio H20 de Nvidia.

Aunque fabricantes nacionales como Huawei han avanzado en el desarrollo de procesadores de IA competitivos, nuestro análisis sugiere que, por lo general, están por detrás del H200 de Nvidia en rendimiento bruto para estas tareas intensivas. Por ejemplo, el Ascend 950 de Huawei aspira a 1 PFLOP en rendimiento FP8, mientras que el Nvidia H200 alcanza los 2 PFLOPs. Esta brecha sustancial resalta por qué, a pesar de sus objetivos a largo plazo de autosuficiencia en semiconductores, China está aceptando un compromiso estratégico a corto plazo.

Nota: Las métricas de rendimiento pueden variar según los puntos de referencia y las configuraciones específicas. El rendimiento FP8 es generalmente para inferencia, mientras que el FP16 se usa a menudo para entrenamiento.

Una tregua condicionada: Navegando las tensiones tecnológicas entre EE. UU. y China

Esta decisión llega tras un periodo de considerable fricción y señales mixtas. El chip H200 había recibido la autorización de exportación de EE. UU. en diciembre de 2025, pero las autoridades chinas habían mantenido el control final sobre si los chips podían entrar físicamente al país. De hecho, las autoridades aduaneras chinas habían indicado previamente que no se permitía la entrada de los chips H200. Este cambio de rumbo subraya el estatus del H200 como un importante foco de tensión en las relaciones entre EE. UU. y China.

Sin embargo, somos profundamente escépticos de que esto suponga un giro real en las tensiones tecnológicas geopolíticas. La demanda de hardware de IA avanzado en China se ha disparado, con empresas tecnológicas invirtiendo fuertemente en centros de datos. Para diciembre de 2025, las firmas tecnológicas chinas habían realizado pedidos de más de dos millones de chips H200, una cantidad que supera con creces la capacidad de producción a corto plazo de Nvidia y su inventario disponible. ¿Podrá Nvidia cumplir con los pedidos masivos de China, o se está gestando una pesadilla en la cadena de suministro global, especialmente cuando Nvidia solo disponía de aproximadamente 700.000 unidades a finales de diciembre?

La letra pequeña: Las condiciones de Pekín y el equilibrio global de Nvidia

Si bien las aprobaciones son un paso positivo para el acceso de Nvidia a un mercado crítico, las fuentes indican que el gobierno chino las está concediendo bajo condiciones que aún se están decidiendo. Cuando escuchamos "condiciones que aún se están decidiendo", sospechamos lo peor. Un informe sugiere que algunas de las licencias iniciales eran demasiado restrictivas, lo que provocó que los clientes aún no hayan convertido estas aprobaciones en pedidos de compra reales. Esto desafía directamente la narrativa de una luz verde sin obstáculos y sugiere que Pekín mantiene un enfoque cauteloso.

Según se informa, otras empresas están esperando la autorización en rondas posteriores o se están uniendo ahora a la cola para aprobaciones sucesivas. Sin embargo, no está claro con qué rapidez se emitirán nuevas autorizaciones ni qué criterios específicos están aplicando los reguladores. Discusiones previas entre las autoridades chinas incluso incluyeron propuestas que podrían exigir que las compras de H200 se vinculen con una proporción determinada de chips nacionales, lo que refleja el compromiso continuo de Pekín por fomentar su industria nativa de semiconductores y, potencialmente, limitar la cuota de mercado de Nvidia.

Además, el Departamento de Comercio de EE. UU. tiene una estipulación que establece que las exportaciones a China y Macao no pueden exceder el 50% de lo que se vende a clientes estadounidenses, lo que podría limitar en última instancia el número total de H200 que ingresan a China, independientemente de la demanda. Para Nvidia, el acceso al mercado chino representa una oportunidad de crecimiento significativa en medio de una intensa competencia global por los procesadores de IA. No obstante, la disponibilidad de los chips H200 podría seguir siendo escasa a nivel mundial debido a que la demanda supera ampliamente la capacidad de producción inmediata de Nvidia. Parece que Nvidia está intentando un delicado acto de equilibrio, navegando entre una inmensa demanda de mercado y complejas restricciones geopolíticas.

Comentarios