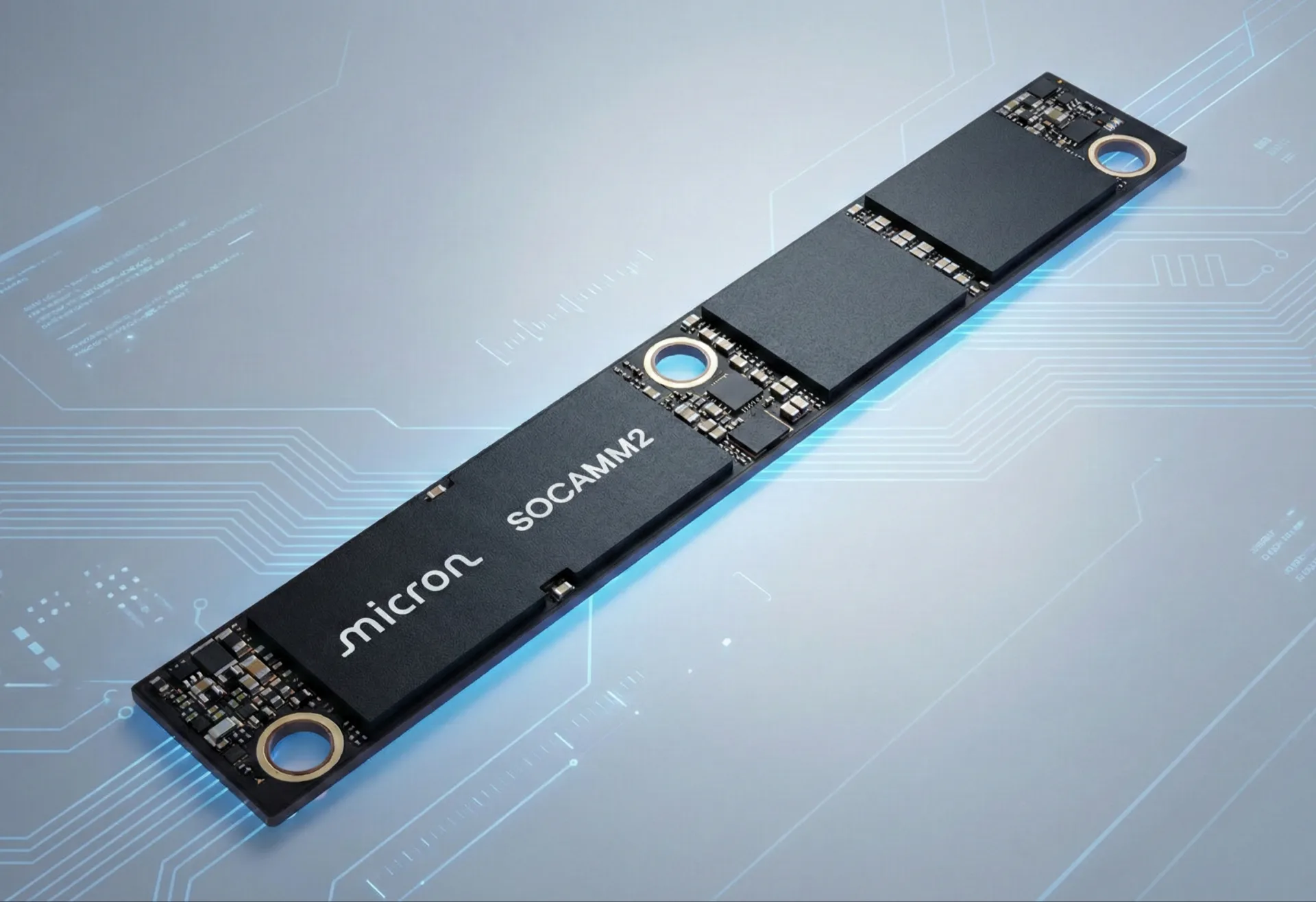

A competição acirrada para sustentar a explosiva infraestrutura de inteligência artificial ao redor do globo está atingindo seu ápice. Por anos, a Memória de Alta Largura de Banda (HBM) reinou absoluta como a escolha preferida para aceleradores de IA de ponta. No entanto, estamos presenciando o surgimento de um novo padrão de memória, o SOCAMM2, posicionado para redefinir as regras do jogo. À medida que avançamos para o início de 2026, rumores da indústria sugerem que gigantes do silício como AMD e Qualcomm estão prontas para integrar o SOCAMM2 em suas próximas linhas de produtos de IA. Este movimento sinaliza uma mudança significativa, visando remodelar a capacidade de memória, a eficiência energética e a economia de sistemas a longo prazo no mercado ferozmente competitivo de centros de dados de IA.

O Gargalo de Memória na IA: Tornando-se Pessoal

Por muito tempo, o poder computacional bruto dos aceleradores de IA dominou as manchetes. Contudo, em nossa visão, o verdadeiro gargalo de hardware para a IA está evoluindo rapidamente de FLOPS brutos para a memória. A proliferação de modelos de linguagem de grande escala (LLMs) e modelos multimodais complexos (MMMs) criou uma demanda insaciável por imensa capacidade de memória, eficiência energética excepcional e arquiteturas escaláveis. Esses modelos exigem quantidades sem precedentes de dados residindo "perto" das unidades de processamento, não apenas para as fases iniciais de treinamento, mas, talvez de forma ainda mais crítica, para a inferência – a operação diária dos modelos de IA em aplicações do mundo real.

A NVIDIA, empresa que detém mais de 90% do mercado de chips de IA, não chegou a isso por acaso. Eles efetivamente pioneiraram o conceito de Módulo de Memória Avançado de Sistema em Chip (SOCAMM), defendendo o padrão SOCAMM2 com amplo apoio da indústria e incorporando-o em seus aceleradores Vera Rubin. Embora a incursão inicial da NVIDIA com o SOCAMM1 tenha enfrentado obstáculos técnicos, forçando um redesenho significativo para o SOCAMM2, seu compromisso contínuo ressalta a importância percebida do padrão. Agora, parece que AMD e Qualcomm estão seguindo o exemplo, não apenas adotando o padrão, mas explorando implementações exclusivas que podem consolidar seus próprios nichos competitivos.

SOCAMM2: Um Novo Espaço de Trabalho Ativo para IA

Vemos o SOCAMM2 como um passo evolutivo crucial na implementação de memória. Ele preenche efetivamente a lacuna entre a memória LPDDR (Low Power Double Data Rate) tradicional soldada, comum em dispositivos móveis, e os DIMMs de servidor soquetados, frequentemente menos eficientes em termos de energia. Posicionado de forma inteligente entre a HBM ultra-rápida, mas de capacidade limitada, e a DRAM de sistema convencional, o SOCAMM2 estabelece um novo "Espaço de Trabalho Ativo" ou "pool de memória de extremidade próxima" especificamente para agentes de IA.

Eis por que o SOCAMM2 é importante:

- Modular e Substituível: Ao contrário da LPDDR permanentemente soldada, os módulos SOCAMM2 são destacáveis. Isso não é apenas uma conveniência menor; para centros de dados, é um fator crítico para a longevidade da plataforma, permitindo atualizações mais fáceis e manutenção aprimorada. Acreditamos que isso melhora drasticamente o custo total de propriedade (TCO) ao longo do tempo.

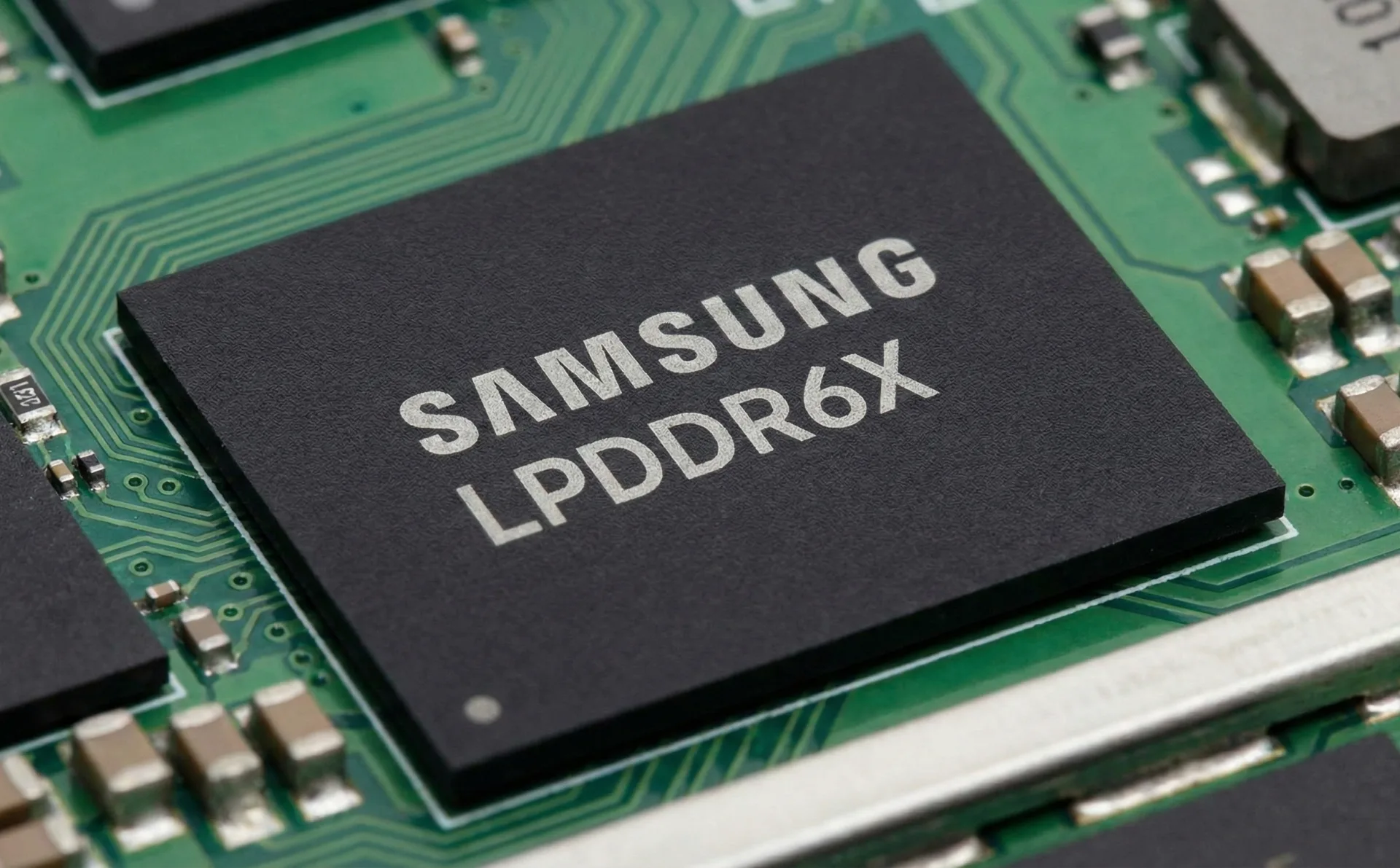

- Baseado em LPDDR: Aproveitando a LPDDR5X hoje, com a LPDDR6 no horizonte, o SOCAMM2 se beneficia de uma tecnologia inerentemente eficiente em energia. A LPDDR6, em particular, promete não apenas um aumento significativo na largura de banda (projetados 38,4 GB/s por canal), mas também cerca de 20% menos consumo de energia que a LPDDR5X.

- Alta Capacidade e Largura de Banda: Esses módulos não ficam para trás, com a Micron já amostrando unidades de até 192 GB. Em sistemas como o GB300 NVL72 da NVIDIA, o SOCAMM2 baseado em LPDDR5X pode contribuir com impressionantes 18 TB de memória com uma largura de banda de sistema de aproximadamente 16 TB/s.

- Eficiência Energética: Ao adotar a tecnologia LPDDR, o SOCAMM2 consome inerentemente menos energia do que os RDIMMs baseados em DRAM padrão. Isso é absolutamente crítico para implantações massivas de IA, onde cada watt contribui significativamente para os custos crescentes de energia.

- Formato Compacto: Seu design simplifica o roteamento da placa e o resfriamento em sistemas densos – uma necessidade para os sistemas de rack de IA de alta densidade que dominam o mercado.

- Padrão JEDEC: A expectativa de que o SOCAMM2 esteja em conformidade com o JEDEC JESD328 é vital. Isso garante a intercambialidade e a neutralidade de fornecedores, o que antecipamos que promoverá uma cadeia de suprimentos mais saudável e competitiva.

Em essência, o SOCAMM2 permite que os modelos de IA retenham milhões de tokens e estados de longa duração diretamente dentro do "pool de memória de extremidade próxima" do acelerador, reduzindo drasticamente o tráfego entre nós e aumentando a eficiência geral do sistema. Embora sua taxa de transferência seja reconhecidamente mais lenta que a HBM, para as demandas de processamento contínuo de muitas cargas de trabalho de IA, especialmente inferência, esses fatores são frequentemente compensados pelas vantagens de capacidade e energia.

A Aposta Ousada da Qualcomm pela Dominância na Inferência

A Qualcomm, gigante de longa data em processadores móveis, entrou oficialmente na festa dos centros de dados de IA em 27 de outubro de 2025, com a revelação de seus aceleradores de inferência AI200 e AI250. Esses chips, previstos para venda em 2026 (AI200) e 2027 (AI250), são um desafio direto à NVIDIA e à AMD, com um foco total na inferência de IA para LLMs e MMMs.

A estratégia da Qualcomm baseia-se em alguns pilares fundamentais:

- Eficiência Energética e TCO: Com um consumo de energia de sistema em rack citado de 160 kW para suas soluções resfriadas a líquido, a Qualcomm prioriza um baixo custo total de propriedade. Isso se alinha perfeitamente com as vantagens energéticas do SOCAMM2.

- Capacidade Massiva de LPDDR: As placas AI200 e AI250 são projetadas para comportar até 768 GB de memória LPDDR cada. Essa imensa capacidade é ideal para lidar com as gigantescas janelas de contexto dos modelos de IA modernos, entregando o que a Qualcomm afirma ser "mais capacidade de memória por menos dinheiro" do que seus concorrentes.

- Arquitetura de Memória Inovadora: O AI250, em particular, ostenta um design de "computação próxima à memória". A Qualcomm afirma que isso entrega um salto geracional em eficiência e um desempenho de largura de banda efetiva até 10 vezes superior em comparação com as GPUs NVIDIA atuais.

- Sistemas em Escala de Rack: A Qualcomm não está apenas vendendo chips; suas ofertas vêm como sistemas completos de racks de servidores resfriados a líquido, capazes de orquestrar até 72 chips como um único computador.

- Integração Exclusiva de PMIC: Relatórios indicam que a Qualcomm, ao lado da AMD, está explorando um design de módulo SOCAMM que incorpora o gerenciamento de energia (PMIC) diretamente no módulo. Isso simplifica a fabricação da placa do sistema e permite um controle de voltagem mais rigoroso, crítico para manter a integridade do sinal em altas taxas de dados.

A Posição Estratégica da AMD e a Sombra da OpenAI

Embora os planos específicos de adoção do SOCAMM2 pela AMD permaneçam menos detalhados do que os da Qualcomm neste estágio, informações sugerem que eles também o estão integrando em suas próximas linhas de produtos de IA. Isso faz todo o sentido estratégico, dada a sua competição direta com a NVIDIA. A integração do SOCAMM2 aumentaria inegavelmente suas ofertas de capacidade de memória e velocidade.

Antecipamos que o interesse da AMD espelhe o da Qualcomm: aproveitar a LPDDR para eficiência energética superior. O cenário competitivo mais amplo também é significativo. Os planos relatados da OpenAI de não apenas comprar chips da AMD, mas potencialmente adquirir uma participação na empresa, poderiam fornecer à AMD um impulso considerável no mercado, desafiando a dominância que antes parecia inabalável da NVIDIA.

Implicações Amplas: O Confronto no Centro de Dados

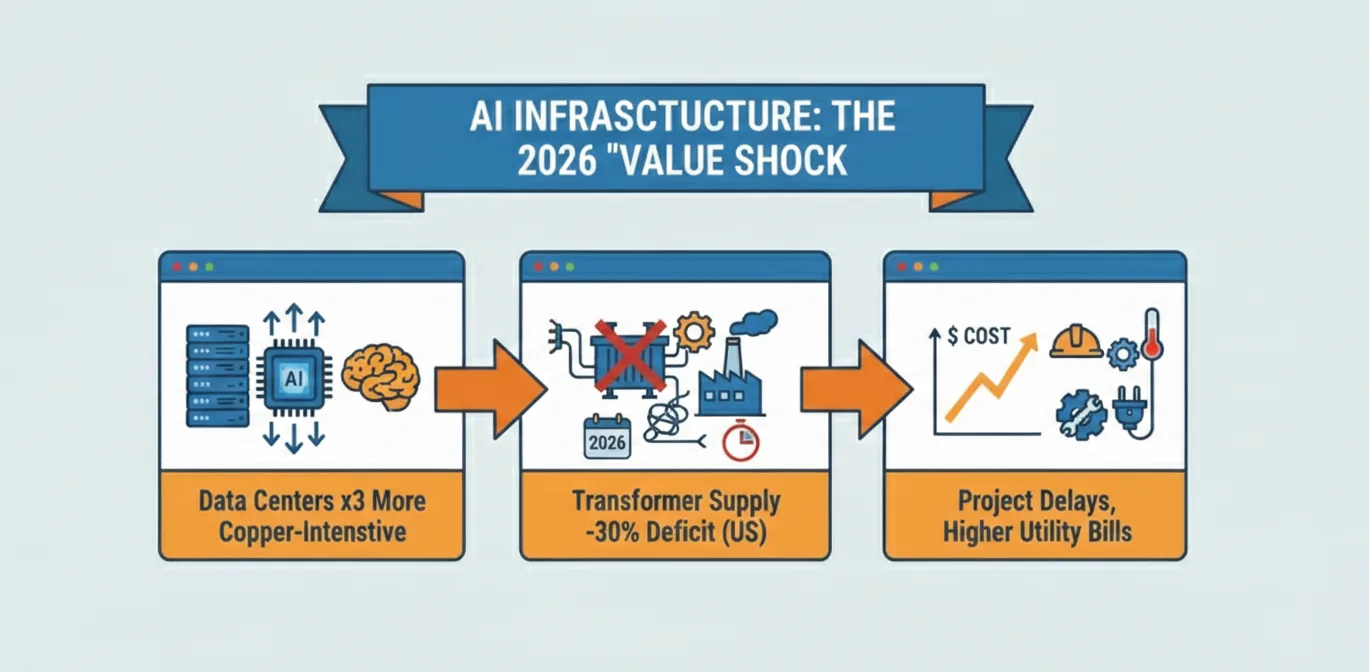

A adoção antecipada do SOCAMM2 pela AMD e pela Qualcomm sinaliza um movimento unido da indústria em direção a soluções de memória otimizadas. Com o valor do submercado de servidores de IA projetado para disparar para US$ 298 bilhões até 2025, os riscos não poderiam ser maiores.

No entanto, essa mudança não está isenta de obstáculos:

- Gestão Térmica: Agrupar inúmeros dispositivos LPDDR em um módulo compacto cria desafios de densidade de calor. O resfriamento líquido direto está evoluindo rapidamente de uma solução de nicho para uma necessidade fundamental.

- Desenvolvimento do LPDDR6: Embora promissor, o LPDDR6 ainda está em estágio de verificação técnica. Incertezas sobre compatibilidade e custos de produção em massa persistem.

- Barreiras de Comercialização: A alta velocidade de transferência do SOCAMM2 pode exigir atualizações de hardware para controladores de memória de servidores mais antigos. O valor real do SOCAMM2 reside na economia total do sistema, e não apenas no preço individual do módulo.

- Ecossistema da NVIDIA: O desafio mais significativo para qualquer novo entrante continua sendo o formidável ecossistema de software CUDA da NVIDIA, que cria um efeito de retenção poderoso para desenvolvedores.

Apesar desses desafios, o ímpeto de múltiplos fornecedores por trás do SOCAMM2 – incluindo NVIDIA, Samsung, SK Hynix e Micron – indica uma forte crença coletiva em seu potencial. Embora a disponibilidade em volume não seja esperada até o início de 2027, o trabalho de base que está sendo feito pela Qualcomm e pela AMD em 2026 prepara o terreno para uma reorganização dramática na hierarquia de memória de IA. Acreditamos que o SOCAMM2 está estabelecendo as bases para um futuro de inteligência artificial mais sustentável, escalável e eficiente.

Comentários