La compétition acharnée pour alimenter l'infrastructure mondiale d'intelligence artificielle atteint un point de rupture. Pendant des années, la mémoire à haute bande passante (HBM) a régné sans partage en tant que solution de choix pour les accélérateurs d'IA de pointe. Cependant, nous assistons aujourd'hui à l'émergence d'un nouveau standard, le SOCAMM2, prêt à redéfinir les règles du jeu. À l'approche de 2026, les rumeurs de l'industrie suggèrent que les géants du silicium AMD et Qualcomm sont prêts à intégrer le SOCAMM2 dans leurs prochaines gammes de produits IA. Ce mouvement signale un pivot stratégique majeur visant à optimiser la capacité mémoire, l'efficacité énergétique et l'économie globale des systèmes sur le marché hyper-concurrentiel des centres de données.

Le goulot d'étranglement de l'IA : une question de mémoire

Pendant trop longtemps, la puissance de calcul brute des accélérateurs d'IA a monopolisé l'attention. Pourtant, de notre point de vue, le véritable verrou matériel de l'IA se déplace rapidement des "FLOPs" vers la mémoire. La prolifération des modèles de langage massifs (LLM) et des modèles multimodaux complexes (MMM) a créé une demande insatiable pour une capacité mémoire immense et une architecture évolutive. Ces modèles nécessitent que des quantités sans précédent de données résident "à proximité" des unités de calcul, non seulement pour l'entraînement, mais surtout pour l'inférence — l'utilisation quotidienne des modèles dans des applications réelles.

NVIDIA, qui contrôle plus de 90 % du marché des puces IA, n'est pas arrivée là par hasard. L'entreprise a été pionnière dans le concept SOCAMM (System-on-Chip Advanced Memory Module), soutenant le standard SOCAMM2 au sein de ses accélérateurs Vera Rubin. Si les premières tentatives de NVIDIA avec le SOCAMM1 auraient rencontré des obstacles techniques imposant une refonte, son engagement continu souligne l'importance vitale de ce standard. Désormais, AMD et Qualcomm emboîtent le pas, non seulement en adoptant la norme, mais en explorant des implémentations uniques pour se démarquer.

SOCAMM2 : Un nouvel espace de travail actif pour l'IA

Nous considérons le SOCAMM2 comme une étape cruciale dans l'évolution du déploiement de la mémoire. Il comble efficacement le fossé entre la mémoire LPDDR (Low Power Double Data Rate) soudée, classique dans les appareils mobiles, et les barrettes DIMM de serveur interchangeables mais souvent énergivores. Positionné stratégiquement entre la HBM ultra-rapide mais limitée en capacité et la DRAM système conventionnelle, le SOCAMM2 établit un nouvel "espace de travail actif" dédié aux agents d'IA.

Voici pourquoi le SOCAMM2 change la donne :

- Modulaire et interchangeable : Contrairement à la LPDDR soudée, les modules SOCAMM2 sont détachables. Pour les centres de données, c'est un facteur critique de longévité des plateformes, facilitant les mises à niveau et la maintenance. Cela améliore considérablement le coût total de possession (TCO).

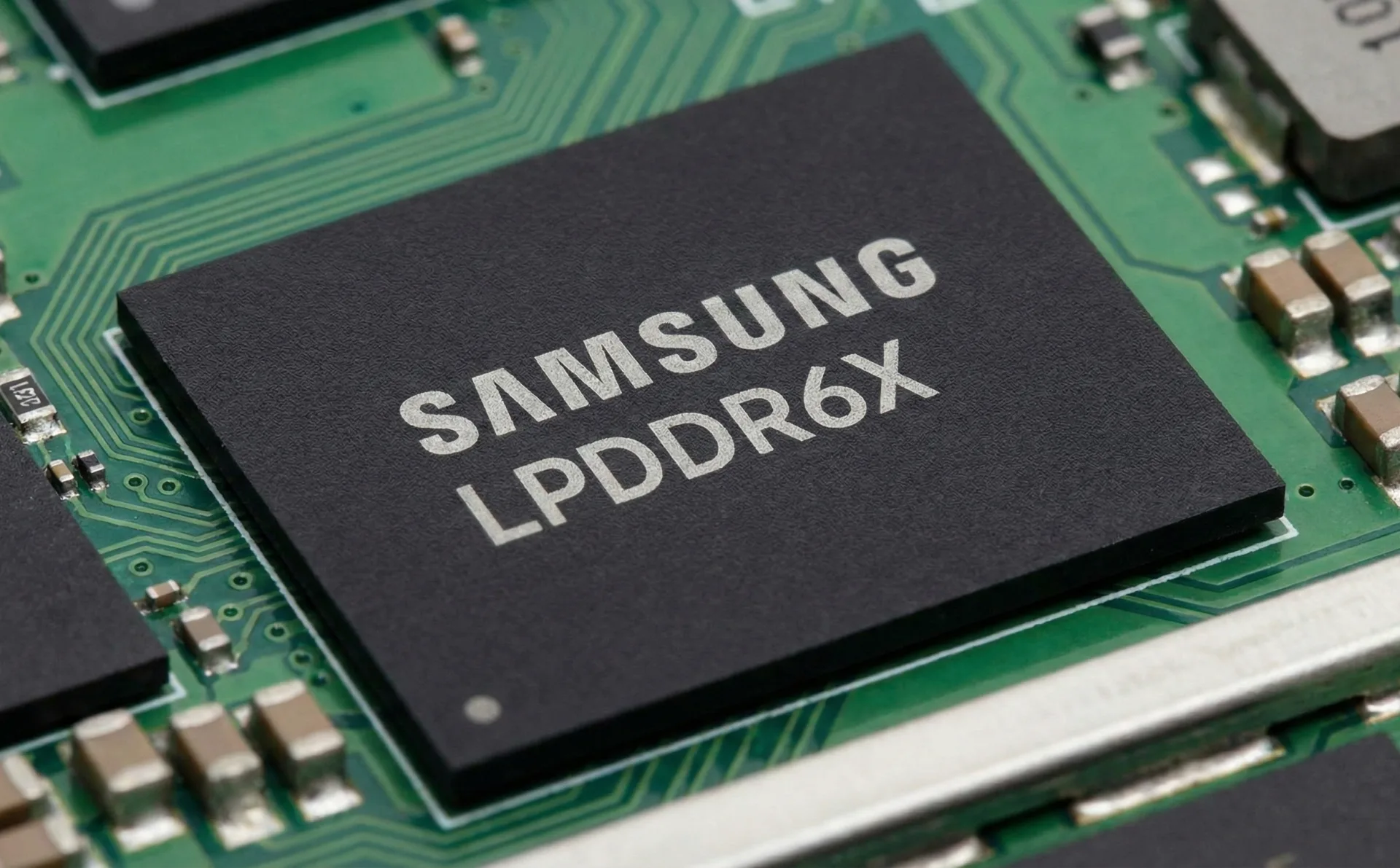

- Basé sur la technologie LPDDR : En exploitant la LPDDR5X actuelle et bientôt la LPDDR6, le SOCAMM2 bénéficie d'une technologie intrinsèquement sobre. La LPDDR6 promet non seulement une bande passante accrue (environ 38,4 Go/s par canal), mais aussi une consommation réduite de 20 % par rapport à la génération précédente.

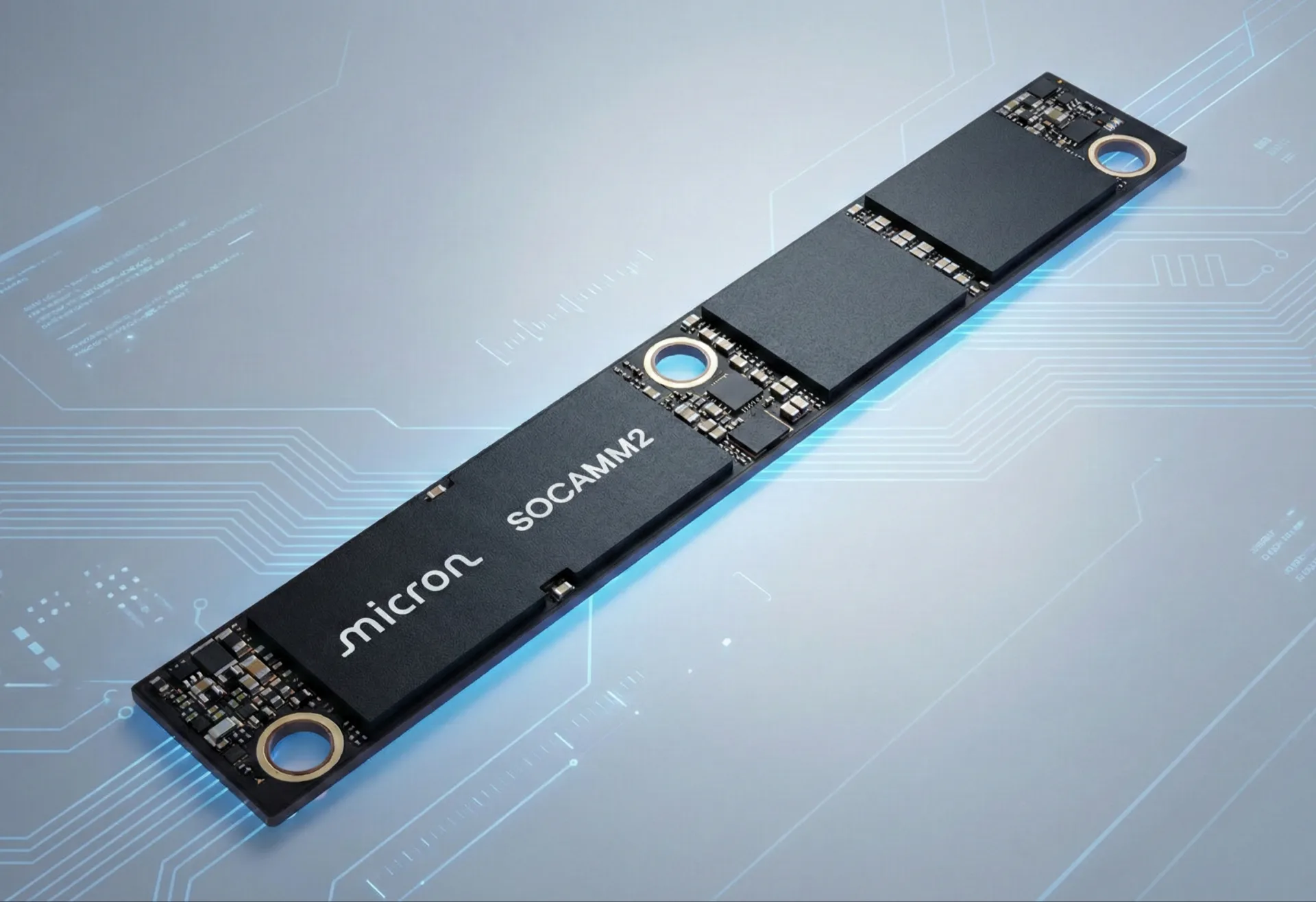

- Haute capacité et débit : Ces modules ne manquent pas de puissance. Micron échantillonne déjà des unités de 192 Go. Dans des systèmes comme le NVIDIA GB300 NVL72, le SOCAMM2 peut contribuer à un pool massif de 18 To de mémoire.

- Efficacité énergétique : La réduction de la consommation est vitale pour les déploiements d'IA à grande échelle où chaque watt économisé réduit les coûts opérationnels colossaux.

- Format compact : Sa conception simplifie le routage des cartes mères et le refroidissement dans les systèmes denses en rack.

- Standard JEDEC : La conformité attendue à la norme JEDEC JESD328 garantit l'interopérabilité entre les fournisseurs, évitant ainsi la dépendance exclusive à un seul fabricant.

En substance, le SOCAMM2 permet aux modèles d'IA de conserver des millions de jetons (tokens) directement dans la mémoire locale de l'accélérateur, réduisant ainsi le trafic entre les nœuds et dopant l'efficacité globale. Bien que son débit soit inférieur à celui de la HBM, ces limites sont souvent compensées par les gains de capacité et d'énergie, particulièrement pour l'inférence.

L'offensive de Qualcomm sur l'inférence

Qualcomm, titan historique des processeurs mobiles, a officiellement fait son entrée dans les centres de données IA fin 2025 avec ses accélérateurs AI200 et AI250. Prévues pour 2026 et 2027, ces puces visent directement NVIDIA et AMD avec une focalisation laser sur l'inférence des LLM.

La stratégie de Qualcomm repose sur plusieurs piliers :

- Efficacité énergétique et TCO : Avec une consommation annoncée de 160 kW pour leurs solutions en rack refroidies par liquide, Qualcomm priorise le coût opérationnel, un argument de poids pour les opérateurs de centres de données.

- Capacité LPDDR massive : Les cartes AI200 et AI250 sont conçues pour embarquer jusqu'à 768 Go de mémoire LPDDR chacune. Cette capacité est idéale pour gérer les fenêtres contextuelles gigantesques des modèles modernes.

- Architecture "Near-Memory Computing" : Qualcomm revendique un bond générationnel en matière d'efficacité, affirmant que son architecture AI250 offre une bande passante effective 10 fois supérieure aux GPU NVIDIA actuels tout en consommant moins d'énergie.

- Systèmes à l'échelle du rack : Qualcomm ne vend pas seulement des puces, mais des racks complets capables de faire fonctionner 72 puces comme un seul ordinateur, rivalisant avec les solutions de NVIDIA et AMD.

- Intégration PMIC unique : Qualcomm et AMD exploreraient des modules SOCAMM incluant la gestion de l'alimentation (PMIC) directement sur le module, ce qui simplifierait la fabrication des cartes mères et permettrait un contrôle plus précis de la tension.

Le partenariat précoce avec la société saoudienne Humain pour déployer des systèmes de 200 mégawatts dès 2026 démontre que l'approche de Qualcomm axée sur l'inférence et la LPDDR trouve déjà un écho sur le marché.

La posture stratégique d'AMD et l'ombre d'OpenAI

Bien que les plans spécifiques d'AMD pour le SOCAMM2 soient moins détaillés que ceux de Qualcomm, les rapports indiquent une intégration dans leurs prochaines lignes de produits IA. C'est une décision logique pour rester compétitif face à NVIDIA. AMD possède déjà un solide portefeuille de CPU et GPU serveurs ; l'ajout du SOCAMM2 renforcerait leur offre en termes de capacité mémoire.

L'intérêt d'AMD rejoint celui de Qualcomm : utiliser la LPDDR pour une meilleure efficacité énergétique. Par ailleurs, le paysage concurrentiel pourrait être bouleversé par OpenAI. Les rumeurs suggèrent que l'organisation pourrait non seulement acheter des puces AMD, mais aussi prendre une participation dans l'entreprise. Une telle alliance ferait d'AMD un concurrent bien plus redoutable pour NVIDIA.

Implications globales : un duel au sommet des centres de données

L'adoption anticipée du SOCAMM2 par AMD et Qualcomm signale un mouvement collectif de l'industrie vers des solutions de mémoire optimisées. Avec un marché des serveurs IA projeté à 298 milliards de dollars d'ici 2025, les enjeux sont financiers autant que technologiques.

Toutefois, ce virage comporte des défis :

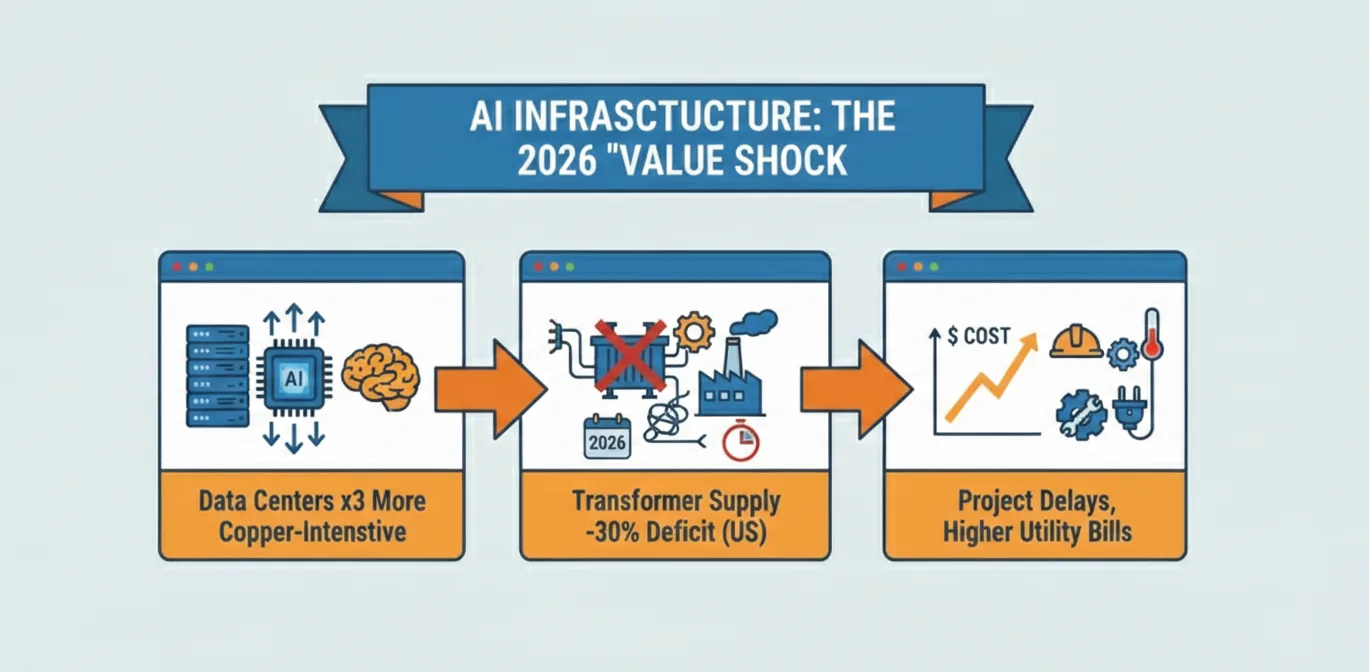

- Gestion thermique : La densité des composants LPDDR dans un module compact génère une chaleur importante. Le refroidissement liquide direct, autrefois de niche, devient une nécessité absolue.

- Développement de la LPDDR6 : Bien que prometteuse, la LPDDR6 est encore en phase de vérification technique. Son succès dépendra de sa capacité à être produite en masse à un coût maîtrisé.

- Obstacles à la commercialisation : Les vitesses de transfert élevées du SOCAMM2 pourraient nécessiter des mises à jour matérielles des contrôleurs de mémoire existants, ralentissant potentiellement l'adoption.

- L'écosystème NVIDIA : Le plus grand défi pour tout nouvel entrant reste l'écosystème logiciel CUDA de NVIDIA, qui verrouille les développeurs et l'infrastructure existante.

Malgré cela, l'élan derrière le SOCAMM2 — porté par NVIDIA, Samsung, SK Hynix, Micron et Foresee — témoigne d'une confiance solide dans son potentiel à long terme. Si la disponibilité massive n'est pas attendue avant 2027, les jalons posés par Qualcomm et AMD dès le début de 2026 préparent une restructuration profonde de la hiérarchie de la mémoire IA. Le SOCAMM2 pose les bases d'un avenir de l'IA plus durable, évolutif et performant.

Commentaires