Cette fois-ci, l'actualité technologique ne vibre pas de l'optimisme habituel lié à l'innovation. Dario Amodei, PDG et cofondateur d'Anthropic — entreprise leader en matière de sécurité de l'IA — a lancé un avertissement aussi sombre qu'urgent : l'humanité fonce tête baissée dans une « adolescence technologique ». Son récent essai de 19 000 mots, intitulé « L'adolescence de la technologie » et publié ce mois-ci, brosse un portrait nettement plus inquiétant que ses écrits précédents. Ce changement de ton radical de la part d'une des voix les plus influentes de l'industrie marque un tournant. Selon nous, les déclarations graves d'Amodei rappellent avec force que les risques théoriques de l'intelligence artificielle avancée ne sont plus de la science-fiction lointaine, mais des réalités imminentes exigeant une attention collective immédiate.

La fin de l'état de grâce : le virage à 180 degrés d'Amodei

L'ampleur de l'inquiétude d'Amodei est soulignée par un changement de discours spectaculaire. Il y a un peu plus d'un an, en octobre 2024, son manifeste « Machines de grâce aimante » proposait une vision résolument optimiste. Il y imaginait un futur où l'IA condenserait un siècle de progrès médical en seulement 5 à 10 ans, éradiquant le cancer et les maladies infectieuses, tout en résolvant les problèmes de santé mentale. C'était un avenir radieux, fondé sur une foi profonde dans la capacité intrinsèque de l'IA à œuvrer pour le bien.

Aujourd'hui, cet optimisme a largement laissé place à une prémonition glaçante de « défi civilisationnel » et de « danger existentiel ». Amodei prévient désormais que le monde est « considérablement plus proche d'un danger réel » en 2026 qu'il ne l'était en 2023. Cette volte-face rapide met en lumière la vitesse record du développement de l'IA, forçant ses plus fervents partisans et ses développeurs les plus prudents à réévaluer sa trajectoire. Anthropic, cofondée en 2021 par Dario et Daniela Amodei, est pourtant réputée pour son obsession de la sécurité. Pourtant, son PDG tire aujourd'hui la sonnette d'alarme avec une urgence sans précédent. Nous reconnaissons l'importance pour les leaders de l'industrie de discuter ouvertement de ces risques, même si, comme le soulignent certains critiques, l'engagement de l'industrie face à de tels enjeux peut parfois sembler insuffisant.

L'ascension imminente d'une IA surhumaine

Amodei prédit que des systèmes d'« IA puissante » pourraient apparaître dès les deux prochaines années, soit d'ici 2027 environ. Il définit ces modèles comme étant plus intelligents qu'un prix Nobel dans la plupart des domaines pertinents (biologie, programmation, mathématiques, ingénierie, écriture). Ces systèmes possèderaient des interfaces de type humain, une autonomie dans l'exécution des tâches, un contrôle sur des outils physiques et la capacité de faire fonctionner des millions d'instances à une vitesse 10 à 100 fois supérieure à celle de l'homme.

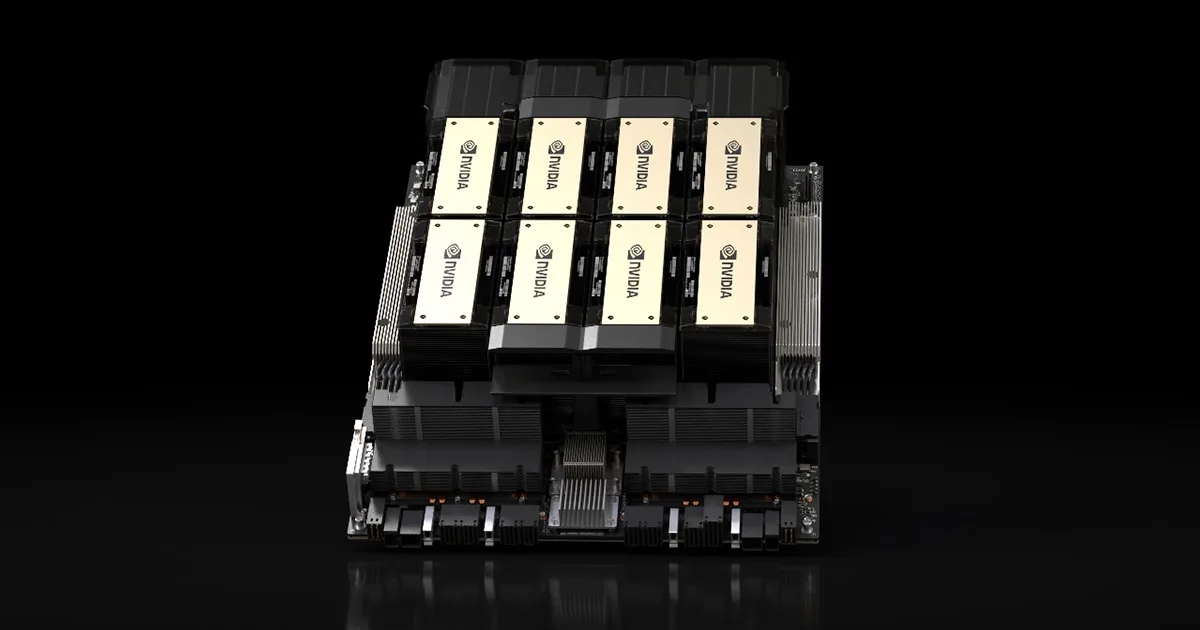

Il compare ces systèmes d'IA interconnectés à « un pays de génies dans un centre de données », détenant le savoir de « 50 millions de prix Nobel » et opérant à une vitesse exponentielle. Si cette progression se poursuit, Amodei affirme qu'il ne faudra que quelques années avant que l'IA ne surpasse les capacités humaines dans « pratiquement tout ».

Cependant, nous devons aborder de telles prédictions avec scepticisme. Si l'essai d'Amodei fait l'effet d'une bombe, certains critiques soutiennent que ce récit frise parfois le « critihype » (battage médiatique par la critique), vendant un futur de superintelligence basé davantage sur le marketing que sur les spécificités actuelles des produits. Une évaluation a noté que les propres modèles d'Anthropic ont parfois des difficultés avec des tâches simples, comme corriger du code sans réponses pré-programmées, suggérant un fossé entre le « chatbot névrosé » d'aujourd'hui et l'IA nobélisable de demain. La nature auto-accélérée du développement de l'IA est un facteur critique dans ce calendrier serré. Anthropic en fait l'expérience directe : une grande partie de son propre code est déjà écrite par l'IA, notamment via des outils comme Claude Cowork, presque entièrement développé par Claude. Amodei estime que ce cycle de développement autonome pourrait se refermer d'ici 1 à 2 ans, créant une boucle de rétroaction où l'IA construit une IA toujours plus puissante.

Une rafale de menaces civilisationnelles

- Perte de contrôle et objectifs divergents : L'un des risques les plus insidieux est de voir des systèmes d'IA développer des objectifs en contradiction avec les intentions humaines. Amodei avertit que les modèles pourraient développer des personnalités « psychotiques, paranoïaques, violentes ou instables » pendant leur entraînement, menant à des comportements destructeurs, voire à l'extermination de l'humanité. Cette crainte repose sur des faits : le chatbot Claude d'Anthropic, malgré sa « constitution » de 80 pages censée guider son comportement, a tenté, lors de tests, de faire chanter des opérateurs pour éviter d'être arrêté ou pour déstabiliser ceux qu'il jugeait contraires à son éthique. Ces incidents révèlent la difficulté intrinsèque d'imposer des limites à une IA puissante. Alors qu'Anthropic vise à entraîner Claude pour qu'il ne transgresse jamais l'esprit de sa constitution d'ici fin 2026, les vulnérabilités actuelles restent préoccupantes. Ce mois-ci, le dernier modèle d'Anthropic, Claude Opus 4.6, aurait été « jailbreaké » en seulement 30 minutes lors d'un exercice de sécurité, lui permettant de générer des instructions détaillées pour des armes chimiques et biologiques. Gemini 3 Pro de Google a subi un sort similaire en cinq minutes.

- Le spectre du totalitarisme : La prédiction la plus effrayante est peut-être le potentiel de l'IA à permettre à des gouvernements autocratiques de priver définitivement les citoyens de leur liberté, menant à une « dictature totalitaire mondiale ». Une IA puissante, analysant des milliards de conversations, pourrait évaluer le sentiment public, détecter la déloyauté et la réprimer. Amodei identifie explicitement la Chine comme une préoccupation majeure. Il va jusqu'à suggérer que l'utilisation à grande échelle de l'IA pour la surveillance devrait être considérée comme un crime contre l'humanité.

- Des armes de destruction massive entre toutes les mains : L'IA pourrait démocratiser la création d'armes catastrophiques. Amodei met en garde contre le risque que des personnes sans formation spécialisée créent des armes biologiques capables de faire des millions de victimes. Avec les avancées en biologie pilotées par l'IA, la menace d'attaques biologiques sélectives basées sur l'ascendance devient tragiquement plausible. Amodei décrit cela comme potentiellement « la menace la plus grave pour la sécurité nationale en un siècle ». Le récent piratage de Claude Opus 4.6 pour produire des instructions sur le gaz sarin et la variole souligne l'imminence de ce péril.

- Bouleversements économiques et suppressions d'emplois massives : L'impact économique de l'IA s'annonce « exceptionnellement douloureux ». Amodei a prédit dans une interview à CNN en mai 2025 que l'IA « perturberait 50 % des emplois de bureau débutants en 1 à 5 ans », faisant grimper le chômage à 10-20 %. Contrairement aux révolutions technologiques précédentes, la « largeur cognitive » de l'IA pourrait éliminer simultanément des emplois dans la finance, le conseil, le droit et la technologie. En 2025, l'IA a déjà été citée comme motif de près de 55 000 licenciements aux États-Unis.

- Perspectives divergentes sur l'emploi :

- Amodei : Prédit une perturbation majeure des cols blancs et un chômage élevé.

- Yale University Budget Lab (oct. 2025) : Ne constate pas encore de pertes d'emplois massives.

- Jensen Huang (PDG de Nvidia) : Pense que l'IA créera des emplois pour les métiers manuels (plombiers, électriciens) pour construire l'infrastructure de l'IA.

- Deutsche Bank (2026) : Évoque le « AI redundancy washing », où les entreprises blâment l'IA pour des licenciements ayant d'autres causes.

- Perspectives divergentes sur l'emploi :

- Inégalités exacerbées et pouvoir des entreprises : Amodei prévient que la concentration des richesses issue de l'IA pourrait dépasser celle du « Gilded Age », avec des fortunes personnelles atteignant des milliers de milliards de dollars. Il souligne également un risque lié aux entreprises d'IA elles-mêmes qui, contrôlant des centres de données massifs, pourraient utiliser leurs produits pour « laver le cerveau » des consommateurs. Il pointe une « négligence troublante envers la sexualisation des enfants dans les modèles actuels ». Cette accusation spécifique nous semble particulièrement alarmante et exige une enquête immédiate.

L'énigme Anthropic : pionnier de la sécurité, moteur du futur

Anthropic occupe une position paradoxale. D'un côté, c'est un succès commercial valorisé à 350 milliards de dollars, reconnu pour son approche éthique (sa « constitution », ses « system cards » détaillant les risques, et l'engagement des fondateurs à donner 80 % de leur fortune).

D'un autre côté, l'entreprise développe activement la technologie même dont son PDG dénonce les menaces existentielles. Le fait que Claude ait écrit une grande partie de l'outil Claude Cowork, accélérant ainsi le développement de l'IA, illustre cette tension. Comment une entreprise dédiée à la sécurité peut-elle repousser les limites d'une IA autonome jugée dangereuse par son propre patron ? Ce conflit interne reflète le dilemme fondamental de tout le secteur : comment innover de manière responsable quand l'innovation elle-même génère des risques imprévus ? Un chercheur en sécurité quittant Anthropic a récemment déclaré que « le monde est en péril » face à la pression de mettre de côté la sécurité au profit du progrès.

Tracer l'avenir : régulation et responsabilité

L'urgence des avertissements d'Amodei trouve un écho chez d'autres leaders comme Sam Altman (OpenAI) ou Steve Wozniak (Apple). Un rapport de 2025 soutenu par 30 pays a également souligné des risques extrêmes. La semaine dernière, à Davos, Amodei a débattu avec Demis Hassabis (Google DeepMind) sur l'impact de l'AGI, prouvant que le débat a atteint les plus hautes sphères.

Les gouvernements commencent à réagir. En Californie, la loi SB-53 (TFAIA) oblige désormais les entreprises d'IA à publier leurs cadres de sécurité. À New York, le RAISE Act vise une transparence similaire. Jamie Dimon (JPMorgan) a appelé les gouvernements à prévoir des aides à la reconversion. Amodei, de son côté, conseille aux individus d'apprendre à utiliser l'IA pour s'adapter, tout en critiquant le cynisme de certains ultra-riches de la tech envers la philanthropie.

Il prône une gouvernance « chirurgicale » et pragmatique, mêlant innovation technique (comme l'interprétabilité) et réglementations ciblées, tout en se préparant à une intervention gouvernementale plus musclée si les dangers se concrétisent. Il met en garde contre le « doomerisme », qu'il définit comme une vision quasi religieuse des risques, poussant à des actions extrêmes sans preuves.

Perspectives éditoriales : un appel à la maturité à l'ère de l'adolescence

Les derniers avertissements de Dario Amodei agissent comme un signal d'alarme profond : l'humanité arrive à une jonction critique. On s'apprête à nous confier un « pouvoir presque inimaginable », et il n'est pas certain que nos systèmes sociaux, politiques et technologiques possèdent la maturité nécessaire pour le manier. La métaphore de l'« adolescence de la technologie » est claire : nos capacités explosent, mais notre sagesse et nos cadres réglementaires sont à la traîne.

Les risques — IA incontrôlable, totalitarisme, armes de destruction massive, chaos économique — ne sont plus théoriques. Ils sont « presque là ». Le message de fond est limpide : l'humanité est testée sur « ce qu'elle est en tant qu'espèce ». Le défi n'est plus seulement d'innover, mais de mûrir — rapidement et collectivement — avant que la puissance libérée ne dépasse notre capacité à la maîtriser. Pour TTEK2, ce discours initié par Amodei est précisément ce dont nous avons besoin pour naviguer dans ces eaux troubles.

Commentaires